Anthropic verklagt die Trump-Regierung: Das Label „Lieferkettenrisiko“ ist illegative Vergeltungsmaßnahme

Künstliche Intelligenz-Software Claude, entwickelt von Anthropic, hat am Montag in einem Bundesgericht in Kalifornien Klage gegen die Trump-Regierung eingereicht. Die Klage wirft der Regierung vor, eine „illegale Vergeltungsmaßnahme“ gegen das Unternehmen gestartet zu haben, weil Anthropic sich geweigert hat, der Militärmacht uneingeschränkten Zugang zu ihrer Technologie zu gewähren – einschließlich für tödliche autonome Waffen und groß angelegte inländische Überwachung. Dies ist das erste Mal in der US-Geschichte, dass ein inländisches Unternehmen als Risiko in der Verteidigungsversorgungskette eingestuft wird.

Risiko in der Lieferkette: Die beispiellose Einstufung des Pentagons

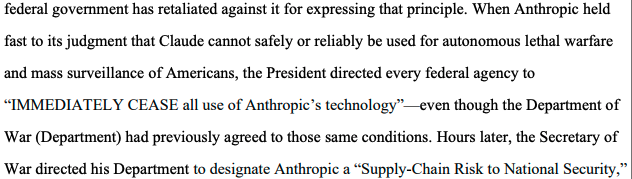

Ausgangspunkt des Rechtsstreits ist eine Entscheidung des Verteidigungsministers Pete Hegseth vom 3. März 2026: Anthropic wurde als Risiko in der Verteidigungslieferkette eingestuft. Die rechtlichen Konsequenzen dieser Einstufung sind direkt und schwerwiegend – jede Person oder Firma, die Geschäfte mit dem Militär macht, darf keine Transaktionen mit Anthropic tätigen, was einer vollständigen Ausschließung vom Bundesbeschaffungsmarkt gleichkommt.

Bemerkenswert ist, dass diese Risiko-Einstufung in der Vergangenheit nur bei Unternehmen angewandt wurde, die mit ausländischen Feindkräften in Verbindung gebracht wurden. Für US-inländische Unternehmen wurde sie bisher nie verwendet. Anthropic bezeichnet diese Maßnahme in der Klage als „beispiellos und illegal“ und argumentiert: „Die Verfassung verbietet es der Regierung, ihre enorme Macht zu nutzen, um ein Unternehmen für geschützte Meinungsäußerungen zu bestrafen.“

Der Rechtsstreit umfasst eine große Anzahl von Beklagten, darunter Pete Hegseth (Verteidigungsminister), Scott Bessent (Finanzminister), Marco Rubio (Außenminister) sowie 17 weitere Regierungsbehörden und Beamte, die mehrere zentrale Bereiche der US-Bundesregierung abdecken.

Anthropic’s rote Linie: Tödliche Waffen und groß angelegte Überwachung

(Quelle: CourtListener)

(Quelle: CourtListener)

Laut Angaben von Anthropic in der Klage forderte Hegseth das Unternehmen auf, „seine Nutzungsbeschränkungen vollständig aufzugeben“ – was Anthropic ablehnte, da diese Beschränkungen selbst Teil ihres Regierungsvertrags sind und dazu dienen, zu verhindern, dass Claude für zwei bestimmte Zwecke verwendet wird:

Tödliche autonome Waffensysteme: Automatisierte Kill-Entscheidungssysteme, die keine endgültige menschliche Entscheidung erfordern

Groß angelegte Überwachung amerikanischer Bürger: Einsatz von KI-Technologie zur massenhaften Sammlung und Analyse persönlicher Daten der Bürger

Anthropic erklärt in der Klage ausdrücklich: „Anthropic hat Claude nie für diese Zwecke getestet. Derzeit ist Anthropic nicht sicher, ob Claude zuverlässig oder sicher in der Unterstützung tödlicher autonomer Kriege eingesetzt werden kann.“

Diese Haltung entspricht den langjährigen Prinzipien von Anthropic zur KI-Sicherheit, steht jedoch im Widerspruch zur Politik der Trump-Regierung, die die militärische Nutzung von KI ausbauen will. Bemerkenswert ist, dass die US-Regierung und das Pentagon seit 2024 Anthropic-Technologie verwenden, wobei Claude die erste KI ist, die in vertraulichen Arbeitsumgebungen eingesetzt wird. Die Einstufung als Risiko geht einher mit einer administrativen Anweisung von Trump, Bundesangestellte anzuweisen, die Nutzung von Claude einzustellen.

Unterstützung durch OpenAI- und Google-Ingenieure: Gemeinsame Reaktion der KI-Branche

Nach Ausbruch des Rechtsstreits reagierte die KI-Branche schnell und breit. Am Montag reichten über 30 Ingenieure und Wissenschaftler von OpenAI und Google, darunter Google-Chef-Wissenschaftler Jeff Dean, eine amicus brief ein, um Anthropic öffentlich zu unterstützen.

Diese Branchenexperten warnen in dem Dokument: „Wenn diese Art der Bestrafung eines der führenden US-amerikanischen KI-Unternehmen fortgesetzt wird, wird dies zweifellos negative Auswirkungen auf die industrielle und wissenschaftliche Wettbewerbsfähigkeit der USA in den Bereichen Künstliche Intelligenz und anderen Feldern haben.“ Die Aussage verweist auf eine größere Sorge: Wenn die US-Regierung die inländischen KI-Unternehmen unter dem Vorwand der Lieferkettenrisiken unterdrückt, könnte dies die zentrale Stärke der USA im globalen KI-Wettbewerb gegen China schwächen.