Googles neues KI-Tool sagt Sturzfluten bis zu 24 Stunden im Voraus voraus

Kurzfassung

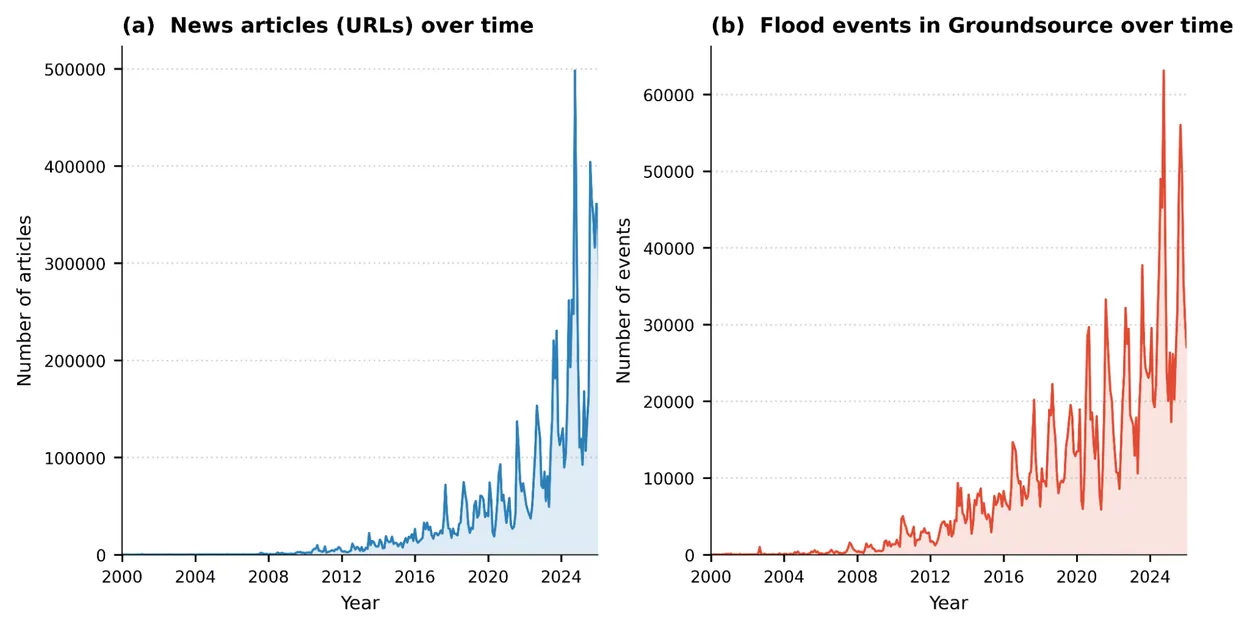

- Google hat den bisher größten Flash-Flood-Datensatz erstellt, indem Gemini zwei Jahrzehnte globaler Nachrichtenberichte durchsucht hat.

- Der Datensatz treibt jetzt ein KI-Modell an, das urbane Überschwemmungen bis zu 24 Stunden im Voraus vorhersagen kann.

- Das System schließt eine große Datenlücke, die lange Zeit die Vorhersage von Flash-Floods blockierte.

Sturzfluten fordern jedes Jahr Tausende von Todesopfern. Sie treten schnell auf, treffen Städte am härtesten, und jahrzehntelang konnten Wissenschaftler kaum etwas dagegen tun, weil die Daten für Trainingsmodelle einfach fehlten. Am Donnerstag sagte Google, es habe eine Lösung für dieses Problem gefunden – durch das Lesen der Nachrichten. Das Unternehmen stellte Groundsource vor, ein System, das Gemini KI nutzt, um Millionen von Nachrichtenartikeln seit 2000 zu durchsuchen, Hinweise auf Überschwemmungsereignisse zu extrahieren und jedes Ereignis einem Ort und einem Datum zuzuordnen. Das Ergebnis ist ein Datensatz mit 2,6 Millionen historischen Flash-Floods aus mehr als 150 Ländern, der jetzt öffentlich zum Download und zur Nutzung bereitsteht.

Dieser Datensatz wurde dann verwendet, um ein neues KI-Modell zu trainieren, das vorhersagen kann, ob in den nächsten 24 Stunden eine Überschwemmung in einer Stadt wahrscheinlich ist. Die Vorhersagen sind jetzt auf Googles Flood Hub live, derselben Plattform, die das Unternehmen bereits nutzt, um rund 2 Milliarden Menschen weltweit vor Flussüberschwemmungen zu warnen. Das Problem, das Groundsource löst, ist erstaunlich einfach. Flüsse haben physische Messstellen – Sensoren im Wasser, die seit Jahrzehnten Pegelstände aufzeichnen. So lernten Vorhersagemodelle, wann ein Fluss überlaufen würde. Stadtstraßen haben so etwas nicht. Wenn starker Regen auf Asphalt trifft und die Abwassersysteme überfordert, passiert die Überschwemmung zu schnell und lokal, um sie mit traditionellen Instrumenten zu verfolgen. Ohne historische Aufzeichnungen kann man kein KI-Modell trainieren, um das Muster zu erkennen. Googles Lösung war, Nachrichtenartikel als das fehlende Sensor-Äquivalent zu behandeln.

„Indem wir öffentliche Informationen in umsetzbare Daten verwandeln, analysieren wir nicht nur die Vergangenheit – wir bauen eine widerstandsfähigere Zukunft für alle auf, mit dem Ziel, dass niemand durch eine Naturkatastrophe überrascht wird“, sagte Google.

Quelle: Google

Nachdem Anzeigen, Navigationsmenüs und Duplikate herausgefiltert und Artikel aus anderen Sprachen ins Englische übersetzt wurden, verwandelte das Team Millionen von unordentlichen Textbeschreibungen in saubere, geolokalisierte Zeitreihendaten. Das auf diesen Daten trainierte Modell nutzt ein LSTM-Neuronales Netzwerk – eine Art KI, die für die Verarbeitung von Sequenzen über die Zeit entwickelt wurde – um stündliche Wettervorhersagen sowie lokale Faktoren wie Urbanisierungsdichte, Bodenabsorptionsraten und Topografie zu verarbeiten. Es gibt dann ein einfaches Signal aus: mittleres oder hohes Hochwasserrisiko in den nächsten 24 Stunden für jede Stadt mit einer Bevölkerungsdichte von über 100 Personen pro Quadratkilometer. Das System hat echte Grenzen. Es deckt nur Gebiete von etwa 20 Quadratkilometern gleichzeitig ab, kann nicht sagen, wie schlimm eine Flut sein wird, und funktioniert in Regionen mit dünner Nachrichtenberichterstattung nicht gut. Dennoch sind die ersten Ergebnisse vielversprechend. Eine regionale Katastrophenschutzbehörde in Südafrika erhielt während der Beta-Phase eine Flood Hub-Warnung, bestätigte die Flut vor Ort und schickte einen humanitären Helfer, um die Reaktion zu koordinieren. Laut Googles Krisenresilienz-Direktorin Juliet Rothenberg ist „diese Kette von Ereignissen – von der Vorhersage im Flood Hub bis zum Einsatz vor Ort – genau das, wofür Flood Hub gebaut wurde.“