OpenAI Lanza GPT-5.4 Mini y Nano, Que Podrían Ser Más Útiles Que el Modelo Grande

En resumen

- OpenAI lanzó GPT-5.4 Mini y Nano, dos modelos más rápidos y económicos diseñados para cargas de trabajo de IA de alto volumen.

- Los modelos sacrifican un poco de precisión por velocidad y costo, dirigidos a tareas repetitivas y sencillas como soporte al cliente y flujos de trabajo automatizados.

- Los desarrolladores ahora pueden ejecutar sistemas híbridos de IA donde un modelo principal planifica tareas y modelos más pequeños manejan la mayor parte del trabajo.

OpenAI no se detiene. Menos de dos semanas después de lanzar GPT-5.4—que fue lanzado solo dos días después de GPT-5.3—la compañía presentó el martes dos modelos más: GPT-5.4 Mini y GPT-5.4 Nano. Estos no son versiones reducidas del modelo principal; son máquinas diseñadas específicamente para trabajos donde esperar medio minuto por una respuesta no es una opción. OpenAI los llama sus “modelos pequeños más capaces hasta ahora,” diciendo que GPT-5.4 Mini es más del doble de rápido que GPT-5 Mini. Si alguna vez has visto a un asistente de codificación pensar 45 segundos antes de editar tres líneas de código, entenderás el atractivo de un modelo rápido.

Estamos presentando GPT-5.4 mini y nano, nuestros modelos pequeños más capaces hasta ahora.

GPT-5.4 mini es más de 2 veces más rápido que GPT-5 mini. Optimizado para codificación, uso de computadoras, comprensión multimodal y subagentes.

Para tareas más ligeras, GPT-5.4 nano es nuestro modelo más pequeño y barato… pic.twitter.com/cdp5HWtM2M

— OpenAI Developers (@OpenAIDevs) 17 de marzo de 2026

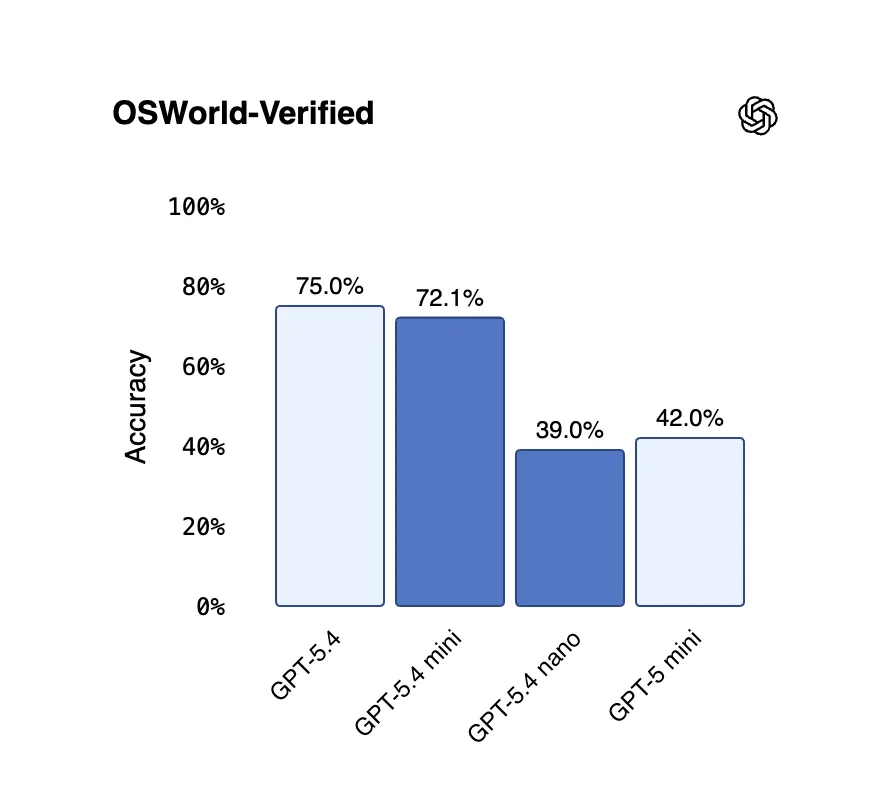

¿Entonces por qué alguien lanzaría un modelo menos preciso a propósito? La respuesta corta: porque la precisión no siempre es el cuello de botella. Si estás ejecutando un chatbot de atención al cliente que responde las mismas 200 preguntas todo el día, no necesitas el modelo que obtuvo la mejor puntuación en exámenes de química a nivel de doctorado. Necesitas uno que responda en menos de un segundo y que cueste una fracción de centavo por respuesta. Ese es el espacio para el que están diseñados estos modelos. Pero eso no significa que estos modelos sean tontos o poco confiables. En pruebas de codificación, GPT-5.4 Mini obtuvo un 54.4% en SWE-Bench Pro—una prueba que mide la capacidad de un modelo para solucionar problemas reales en GitHub—frente a un 45.7% del GPT-5 Mini anterior y un 57.7% del GPT-5.4 completo. En OSWorld-Verified, que evalúa qué tan bien puede un modelo operar realmente una computadora de escritorio leyendo capturas de pantalla, Mini alcanzó un 72.1%, muy cerca del 75.0% del modelo principal—y ambos superan la línea base humana de 72.4%. Por otro lado, GPT-5.4 Nano obtiene un 52.4% en SWE-Bench Pro y un 39.0% en OSWorld—más bajo que Mini, pero aún un gran avance respecto a modelos Nano anteriores.

“GPT-5.4 representa un avance tanto para los modelos Mini como Nano en nuestras evaluaciones internas,” dijo Jerry Ma, CTO adjunto de Perplexity, tras probar ambos. “Mini ofrece un razonamiento sólido, mientras que Nano es receptivo y eficiente para flujos de trabajo conversacionales en vivo.” En lugar de dirigir cada tarea a un modelo principal costoso, ahora puedes construir sistemas donde el modelo grande planifica y coordina, mientras que modelos más pequeños manejan el trabajo real en paralelo—buscando en un código, leyendo un documento, o procesando un formulario en otro lugar. Como vimos en nuestra comparación GPT-5.4 vs. Grok 4.20, la posición del modelo en el flujo de trabajo importa tanto como qué modelo eliges. GPT-5.4 Mini cuesta $0.75 por millón de tokens de entrada y $4.50 por millón de tokens de salida a través de la API. GPT-5.4 Nano es aún más barato: $0.20 por millón de tokens de entrada y $1.25 por millón de tokens de salida—un precio que hace viable financieramente ejecutar una gran cantidad de consultas diarias para startups. Para contexto, Nano es aproximadamente cuatro veces más barato que Mini en entradas. Para usuarios regulares de ChatGPT, GPT-5.4 Mini ya está disponible hoy para usuarios Free y Go a través de la opción “Thinking” en el menú plus. Los suscriptores de pago que alcancen sus límites de GPT-5.4 automáticamente volverán a Mini. Sin embargo, GPT-5.4 Nano, por ahora, solo está disponible vía API—OpenAI claramente lo posiciona como una herramienta para desarrolladores, no para consumidores.