传统 AI 云服务通常依赖大型集中式数据中心,这种模式虽然具备较强的计算能力,但也伴随着 GPU 成本高、资源调度集中以及扩展压力等问题。Theta EdgeCloud 希望通过边缘节点与云计算结合的方式,将全球闲置 GPU 资源整合进网络,从而提高资源利用率并增强分布式协同能力。

在当前 AI 基础设施竞争日益激烈的背景下,Theta EdgeCloud 也被视为 DePIN(去中心化物理基础设施网络)与分布式 GPU 网络方向的重要案例之一。其核心目标并不是完全替代传统云平台,而是在 AI 推理与边缘计算场景中提供更灵活的资源协作模式。

Theta EdgeCloud 是什么

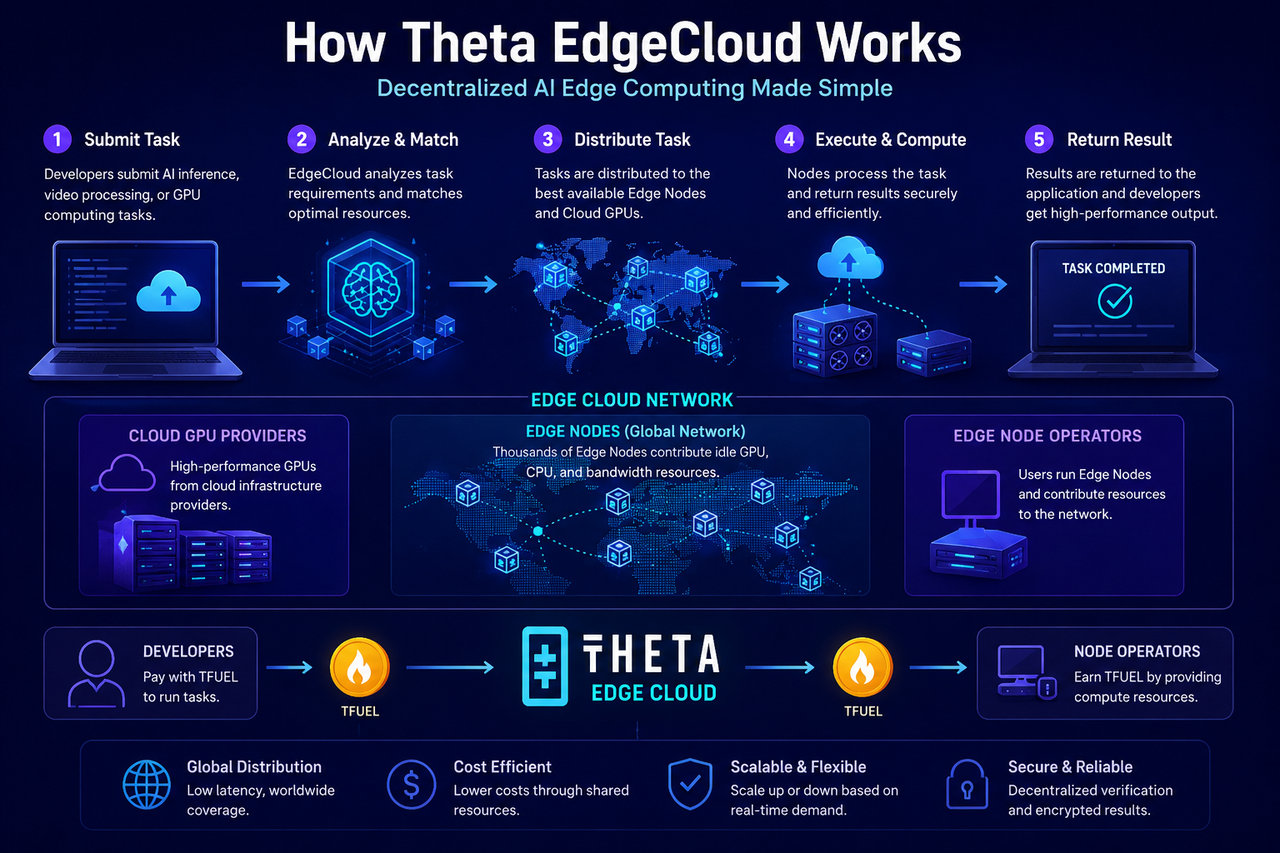

作为建立在 Theta Network 生态上的混合式 AI 云平台,Theta EdgeCloud 的核心逻辑是将分布式 Edge Node 与传统云 GPU 服务结合,形成统一的计算资源网络。

与传统中心化 AI 云服务不同,Theta EdgeCloud 的资源来源不仅包括云服务器,还包括全球用户运行的 Edge Node 节点。这些节点能够共享闲置 GPU、CPU 与带宽资源,用于处理 AI 推理、视频转码与渲染任务。

对于开发者而言,Theta EdgeCloud 更像一个能够动态调度分布式资源的 AI 计算层。开发者无需直接管理底层节点,而是通过平台提交任务,由系统自动完成资源分配与执行。

Theta EdgeCloud 与传统 AI 云服务有什么区别

传统 AI 云平台通常依赖大型数据中心集中提供 GPU 服务,资源调度与管理主要由中心化云服务商完成。这种模式具备成熟的稳定性,但也容易受到 GPU 供应紧张与成本上升影响。

Theta EdgeCloud 则更强调“边缘资源共享”。网络中的 Edge Node 可以来自全球不同地区,部分闲置 GPU 资源能够被重新利用。当 AI 任务进入系统后,平台会根据任务需求、节点状态与计算能力完成资源调度。

相比传统 AI 云平台,Theta EdgeCloud 的主要特点包括:

| 对比维度 | 传统 AI 云平台 | Theta EdgeCloud |

|---|---|---|

| 资源来源 | 中心化数据中心 | 云 GPU + Edge Node |

| 网络结构 | 集中式 | 分布式 |

| GPU 调度 | 平台统一管理 | 动态节点协同 |

| 节点参与 | 云服务商提供 | 用户共享资源 |

| 激励方式 | 服务付费 | TFUEL 奖励机制 |

这种模式使 Theta EdgeCloud 更接近分布式 GPU 网络,而不仅仅是传统意义上的云计算平台。

用户提交 AI 任务后会发生什么

当开发者或应用提交 AI 推理、视频处理或渲染任务后,Theta EdgeCloud 会首先分析任务的资源需求,包括 GPU 类型、显存需求、计算时间与带宽要求。

随后,系统会在网络中寻找符合条件的节点资源。部分任务可能由云 GPU 完成,而部分任务则会分配给全球 Edge Node 协同处理。整个过程由平台自动完成,开发者无需手动选择节点。

任务执行期间,系统会持续监控节点状态与任务进度。如果部分节点出现离线或资源不足情况,平台可能重新分配任务,以保证整体计算稳定性。

任务完成后,结果会返回至应用层,而参与计算的节点则根据资源贡献获得 TFUEL 奖励。

这种模式本质上是一种“分布式资源调度系统”,其核心在于让网络中的闲置算力能够被统一利用。

Edge Node 如何参与 GPU 计算

Edge Node 是 Theta EdgeCloud 的核心组成部分之一。用户运行 Edge Node 后,可以将本地 GPU 与计算资源接入 Theta 网络。

当网络出现 AI 推理、视频渲染或边缘计算需求时,部分任务会被分配至这些节点执行。节点完成任务后,可以根据贡献的计算资源获得 TFUEL 奖励。

与传统矿机不同,Theta Edge Node 的核心功能并不是 PoW 挖矿,而是提供实际计算资源。这也是 Theta 经常被归类为 DePIN 项目的原因之一。

对于普通用户而言,Edge Node 既是参与 Theta 网络的入口,也是资源共享机制的重要组成部分。

TFUEL 如何在 EdgeCloud 中流转

TFUEL 是 Theta EdgeCloud 中的重要资源代币,主要承担网络运行中的支付与激励功能。

开发者提交 AI 或视频任务时,需要支付 TFUEL 作为资源费用。系统随后会根据任务执行情况,将部分 TFUEL 分配给参与计算的 Edge Node。

因此,在 EdgeCloud 体系中,TFUEL 同时连接了:

-

AI 应用开发者

-

GPU 资源提供者

-

Edge Node 网络

-

Theta 基础设施

这种结构形成了“任务支付—资源执行—节点奖励”的循环机制。

Theta EdgeCloud 的主要应用场景

Theta EdgeCloud 当前主要面向 AI 与媒体计算场景。

在 AI 领域,其应用包括:

-

AI 模型推理

-

大语言模型推理

-

图像生成

-

GPU 分布式计算

在视频与媒体领域,Theta EdgeCloud 可用于:

-

视频转码

-

视频渲染

-

直播处理

-

边缘内容分发

由于边缘节点能够分布在不同地区,部分实时性要求较高的任务也能够借助边缘计算降低延迟。

随着 AI 与 Web3 基础设施融合,Theta EdgeCloud 也逐渐成为 Theta 从视频生态扩展至 AI 领域的重要组成部分。

Theta EdgeCloud 面临哪些挑战

虽然分布式 GPU 网络具备资源共享与扩展潜力,但 Theta EdgeCloud 仍然面临一些现实挑战。

首先,边缘节点的硬件能力并不完全统一,不同 GPU 性能差异可能影响任务执行效率。其次,分布式节点网络本身也会增加资源调度与任务管理复杂度。

与此同时,AI 基础设施市场竞争正在快速加剧,包括传统云平台与其他分布式 GPU 网络项目都在争夺 AI 计算市场。

此外,生成式 AI 对高性能 GPU 的需求持续增长,如何稳定获取与调度 GPU 资源,也成为 EdgeCloud 长期发展的关键问题之一。

总结

Theta EdgeCloud 作为 Theta Network 推出的去中心化 AI 与边缘计算平台,其核心目标是通过全球 Edge Node 与云 GPU 协同,构建分布式 AI 计算网络。

相比传统中心化 AI 云服务,Theta EdgeCloud 更强调边缘资源共享、GPU 协同与分布式调度能力。开发者能够通过平台提交 AI 推理与视频处理任务,而全球节点则共同参与资源执行,并通过 TFUEL 获得奖励。

随着 AI 推理与 GPU 需求持续增长,Theta EdgeCloud 也正在推动 Theta 从视频流媒体网络向综合型 AI 基础设施平台扩展。

FAQs

Theta EdgeCloud 如何运作?

开发者提交 AI 或视频任务后,系统会自动将任务分配至云 GPU 与 Edge Node 节点协同处理,并通过 TFUEL 完成资源支付与奖励。

Edge Node 在 EdgeCloud 中有什么作用?

Edge Node 负责提供 GPU 与计算资源,用于执行 AI 推理、视频渲染与边缘计算任务。

Theta EdgeCloud 与传统 AI 云服务有什么区别?

传统 AI 云服务主要依赖集中式数据中心,而 Theta EdgeCloud 则结合边缘节点与云 GPU,形成分布式资源网络。

TFUEL 在 EdgeCloud 中有什么用途?

TFUEL 用于支付 AI 与视频任务费用,同时也是节点完成任务后获得的奖励代币。

Theta EdgeCloud 属于 DePIN 项目吗?

由于其核心逻辑是共享 GPU 与边缘计算资源,Theta EdgeCloud 常被归类为 DePIN 与分布式 GPU 网络方向项目之一。

相关文章

不可不知的比特币减半及其重要性

如何选择比特币钱包?

CKB:闪电网络促新局,落地场景需发力

Master Protocol:激活 BTC 生息潜力