分享币圈内容,享内容挖矿收益

placeholder

speakjustly

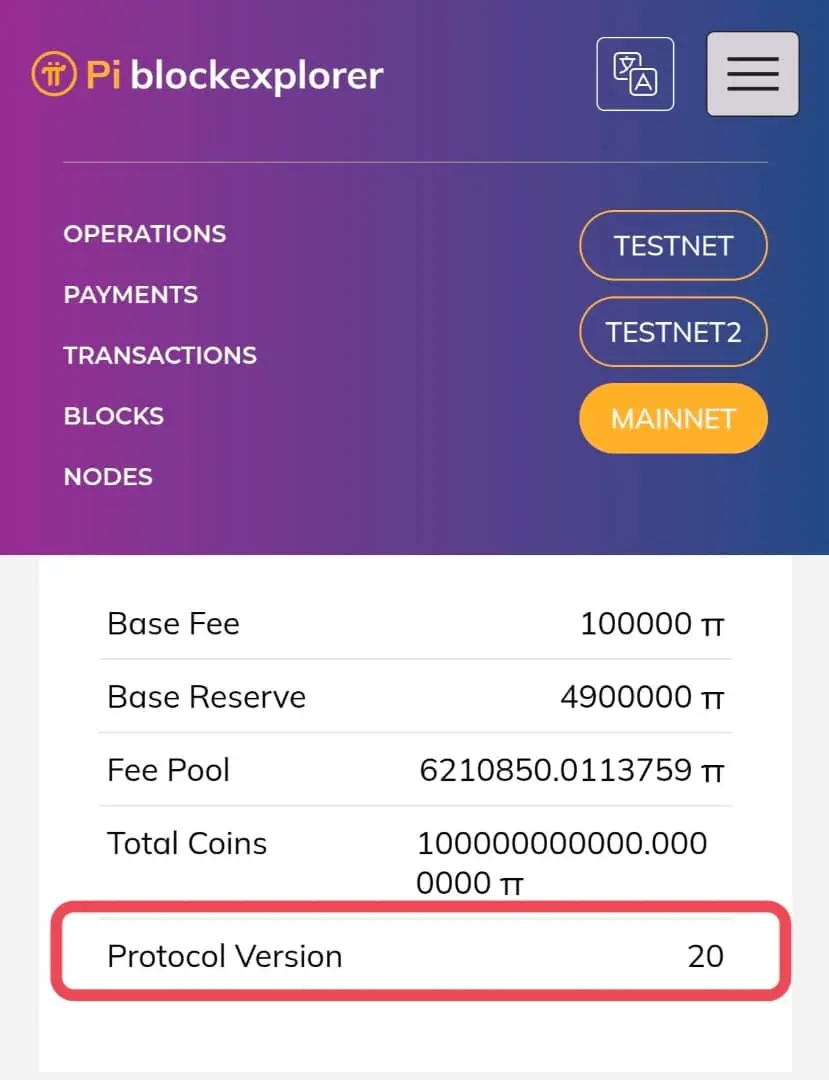

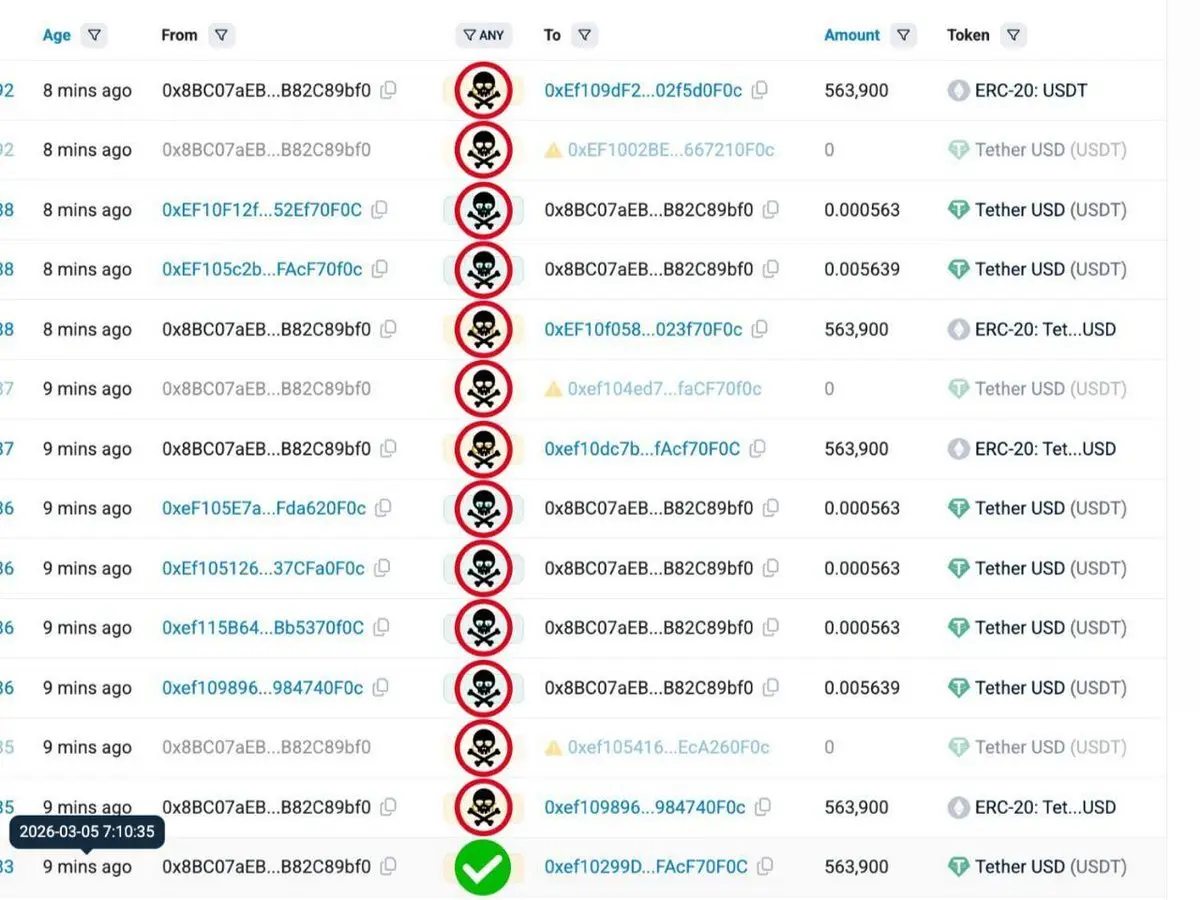

Partisia Blockchain 强调地址中毒利用了透明的交易历史——难以攻击你看不到的东西。

Etherscan 警告这些以太坊上的攻击正变得越来越自动化。

#Partisia # 以太坊 #Security #加密货币

Etherscan 警告这些以太坊上的攻击正变得越来越自动化。

#Partisia # 以太坊 #Security #加密货币

ETH3.12%

- 赞赏

- 2

- 评论

- 转发

- 分享

- 赞赏

- 4

- 1

- 转发

- 分享

HighAmbition :

:

祝你在马年财源广进 🐴Grok

xAI投行分析

创建人@奶味波波茶

上市进度

0.00%

市值:

$2503.44

更多代币

是什么报告让马斯克看了也觉得不可思议?

Moonshot AI(Kimi团队)最近扔出一篇炸裂的技术报告:《Attention Residuals》,直接把 Transformer 里用了快 10年的残差连接(Residual Connections)给升级了。结果连 Elon Musk 都忍不住留言,感觉不可思议(unbelievable 级别的震惊)。

这篇的核心一句话就能概括:

“别再让每一层都傻傻地把前面所有层的信息等权重加起来了,让模型自己学会用注意力去挑哪些早期层的信号才真正有用!”

传统 Transformer(PreNorm结构)里,每一层的输出是:

x_{l} = x_{l-1} + sublayer(x_{l-1} / √something)

简单粗暴:不管前面 100层的信息到底有没有用,都一股脑加进来。层数一深,早期重要信号就被后面无数层稀释得快没了(他们叫这个现象 PreNorm dilution 或 representational dilution)。

Kimi团队直接把这个“+”号换成了一个轻量级的跨层注意力(depth-wise attention):

新公式大概长这样(简化版):

x_l = Attention( Q=x_l^{pre}, K=汇总前面所有层的summary, V=对应value ) + 其他东西

更实际的实现他们叫 Block

Moonshot AI(Kimi团队)最近扔出一篇炸裂的技术报告:《Attention Residuals》,直接把 Transformer 里用了快 10年的残差连接(Residual Connections)给升级了。结果连 Elon Musk 都忍不住留言,感觉不可思议(unbelievable 级别的震惊)。

这篇的核心一句话就能概括:

“别再让每一层都傻傻地把前面所有层的信息等权重加起来了,让模型自己学会用注意力去挑哪些早期层的信号才真正有用!”

传统 Transformer(PreNorm结构)里,每一层的输出是:

x_{l} = x_{l-1} + sublayer(x_{l-1} / √something)

简单粗暴:不管前面 100层的信息到底有没有用,都一股脑加进来。层数一深,早期重要信号就被后面无数层稀释得快没了(他们叫这个现象 PreNorm dilution 或 representational dilution)。

Kimi团队直接把这个“+”号换成了一个轻量级的跨层注意力(depth-wise attention):

新公式大概长这样(简化版):

x_l = Attention( Q=x_l^{pre}, K=汇总前面所有层的summary, V=对应value ) + 其他东西

更实际的实现他们叫 Block

- 赞赏

- 2

- 评论

- 转发

- 分享

最强AI大龙虾带你飞,跟单躺赢

- 赞赏

- 点赞

- 评论

- 转发

- 分享

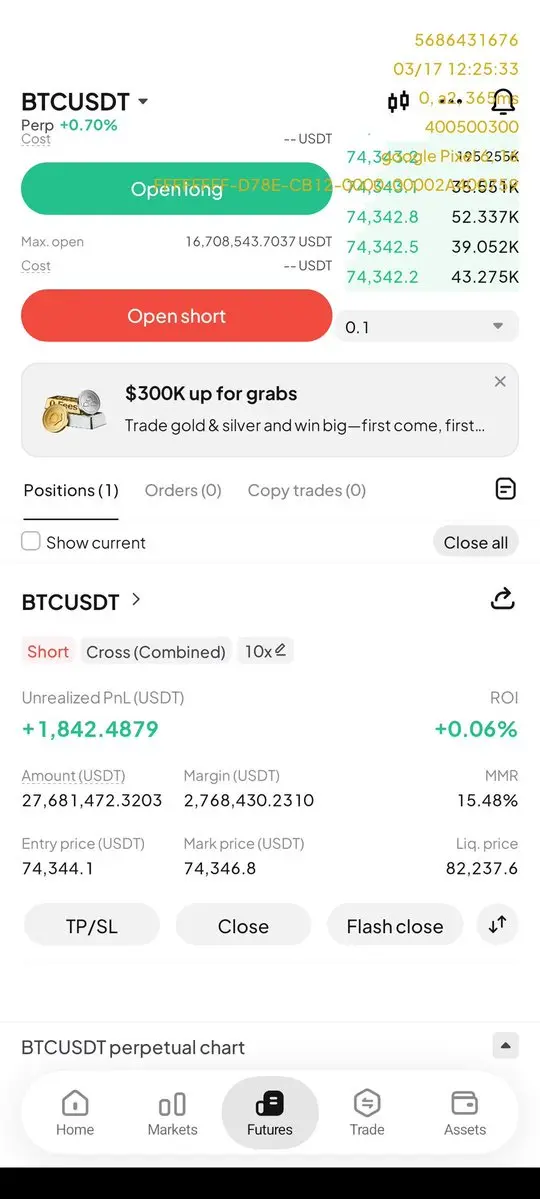

500u挑战 进行中

- 赞赏

- 点赞

- 评论

- 转发

- 分享

- 赞赏

- 2

- 4

- 转发

- 分享

pi壶摇直上 :

:

你看我发的动态,你不能一直开仓,这样赚不到钱,设置好止损,止盈就行了,不要一直看着,动一动你就反手一波,这样到最后只有亏钱,我今天买空0.1793平仓的,今天赚了1100查看更多

- 赞赏

- 点赞

- 评论

- 转发

- 分享

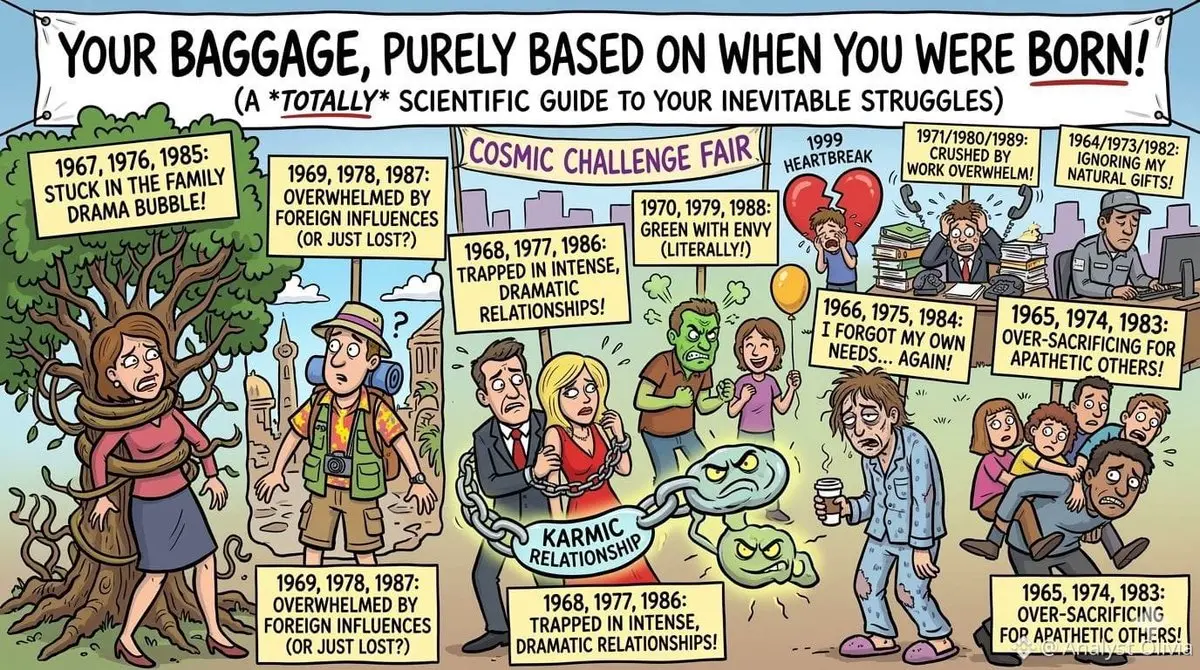

这些年份出生的人通常会面临类似的人生模式:

🔹 1967、1976、1985、1994、2003——家庭模式与成长中的挑战

🔹 1969、1978、1987、1996、2005——通过异国他乡或影响而获得的教训

🔹 1968、1977、1986、1995、2004——激烈或因果关系的关系

🔹 1970、1979、1988、1997、2006——内心的斗争:愤怒、嫉妒、比较

🔹 1966、1975、1984、1993——忽视自我关爱与个人需求

🔹 1965、1974、1983、1992、2001——过度为他人牺牲

🔹 1971、1980、1989、1998、2007——工作与生活失衡

🔹 1999——重大心碎或分离

🔹 1964、1973、1982、1991——浪费或被忽视的才能

觉察是打破这些模式的第一步。

查看原文🔹 1967、1976、1985、1994、2003——家庭模式与成长中的挑战

🔹 1969、1978、1987、1996、2005——通过异国他乡或影响而获得的教训

🔹 1968、1977、1986、1995、2004——激烈或因果关系的关系

🔹 1970、1979、1988、1997、2006——内心的斗争:愤怒、嫉妒、比较

🔹 1966、1975、1984、1993——忽视自我关爱与个人需求

🔹 1965、1974、1983、1992、2001——过度为他人牺牲

🔹 1971、1980、1989、1998、2007——工作与生活失衡

🔹 1999——重大心碎或分离

🔹 1964、1973、1982、1991——浪费或被忽视的才能

觉察是打破这些模式的第一步。

- 赞赏

- 1

- 评论

- 转发

- 分享

芝麻传奇

芝麻传奇之路

创建人@gatefunuser_e111

上市进度

100.00%

市值:

$2145.21

更多代币

📣3/17以太坊趋势深度解析及后市风险建议分享:

从图表来看,以太坊自近期低点启动后呈现单边逼空走势,4小时级别连续阳线拉升,价格站在所有均线上方,主图均线呈现标准的多头排列。目前整体趋势并未破坏,但短期因涨幅过大,存在技术性回调的需求。以下是详细的走势分析与操作建议:

技术指标深度解析

布林带(BOLL)

现状:价格(2329.76)紧贴布林带上轨(UP:2379.81)运行,上轨开口向上发散。

解读:这是典型的强势单边行情特征。价格贴着上轨走说明多头力量极强,但同时也意味着处于超买区。

风险:目前价格略低于上轨,且出现了小幅回落插针,表明2380-2390区间存在强抛压,短期内难以直接直线拉升,大概率会回踩中轨(MID:2177.56)附近进行蓄力。

MACD(异同移动平均线)

现状:DIF(69.06)与DEA(51.33)双线在零轴上方高位运行,红柱(MACD:35.47)虽然保持正值但放量速度放缓。

解读:多头动能依然占据主导,但动能衰减迹象明显。这通常是上涨末端的信号,提示短期追高风险急剧增加,市场可能会通过震荡来消化高位获利盘。

KDJ(随机指标)

现状:K值(82.63)、D值(82.92)、J值(82.04)全部处于高位超买区间,且J值开始有拐头向下的趋势。

解读:KDJ在高位钝化是强势行情的常态,但如果出现死

从图表来看,以太坊自近期低点启动后呈现单边逼空走势,4小时级别连续阳线拉升,价格站在所有均线上方,主图均线呈现标准的多头排列。目前整体趋势并未破坏,但短期因涨幅过大,存在技术性回调的需求。以下是详细的走势分析与操作建议:

技术指标深度解析

布林带(BOLL)

现状:价格(2329.76)紧贴布林带上轨(UP:2379.81)运行,上轨开口向上发散。

解读:这是典型的强势单边行情特征。价格贴着上轨走说明多头力量极强,但同时也意味着处于超买区。

风险:目前价格略低于上轨,且出现了小幅回落插针,表明2380-2390区间存在强抛压,短期内难以直接直线拉升,大概率会回踩中轨(MID:2177.56)附近进行蓄力。

MACD(异同移动平均线)

现状:DIF(69.06)与DEA(51.33)双线在零轴上方高位运行,红柱(MACD:35.47)虽然保持正值但放量速度放缓。

解读:多头动能依然占据主导,但动能衰减迹象明显。这通常是上涨末端的信号,提示短期追高风险急剧增加,市场可能会通过震荡来消化高位获利盘。

KDJ(随机指标)

现状:K值(82.63)、D值(82.92)、J值(82.04)全部处于高位超买区间,且J值开始有拐头向下的趋势。

解读:KDJ在高位钝化是强势行情的常态,但如果出现死

ETH3.12%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

👀 德国对特朗普说:"这不是北约的战争"

柏林表示伊朗冲突"不是北约的战争",拒绝了特朗普总统要求盟国在霍尔木兹海峡行动的呼吁。

德国官员强调北约是防御性联盟,目的是保护成员领土,而不是参与这场冲突。

查看原文柏林表示伊朗冲突"不是北约的战争",拒绝了特朗普总统要求盟国在霍尔木兹海峡行动的呼吁。

德国官员强调北约是防御性联盟,目的是保护成员领土,而不是参与这场冲突。

- 赞赏

- 1

- 评论

- 转发

- 分享

除了定投BTC,这几年我还在定投ETF。

很多人一说投资,就开始研究个股、看K线,其实对大多数普通人来说,有一个更简单的方式,那就是 ETF。

ETF本质上就是一篮子股票,你买一只ETF,其实就相当于同时投资很多家公司,风险更分散,也更适合长期投资。

如果只选三个ETF做基础配置,我会看这三个。

第一个是 VOO

VOO追踪的是 标普500指数,里面是美国最顶尖的500家公司,比如苹果、微软、亚马逊这些巨头。

简单理解就是,你买VOO,其实就是在投资美国最强的一批公司。过去五年平均回报大概在 15%左右,很多人都会把它当作投资组合里的核心资产。

第二个是 QM

它追踪的是 纳斯达克100指数,也就是科技板块。里面有英伟达、苹果、Meta这些科技巨头。

如果你相信未来十年科技还会继续爆发,那QM其实就是在押注科技行业的长期增长。

第三个是 US

US投资的是 美国以外的全球公司。很多人投资只买美国市场,但US可以帮你把资金分散到全球。

如果未来美国市场出现波动,US也能帮你的投资组合降低风险。

简单来说,这三个ETF代表三件事:VOO代表美国核心经济,QM代表科技成长,US代表全球分散。

对于普通投资者来说,很多时候最难的不是选资产,而是 长期坚持投资。

很多人一说投资,就开始研究个股、看K线,其实对大多数普通人来说,有一个更简单的方式,那就是 ETF。

ETF本质上就是一篮子股票,你买一只ETF,其实就相当于同时投资很多家公司,风险更分散,也更适合长期投资。

如果只选三个ETF做基础配置,我会看这三个。

第一个是 VOO

VOO追踪的是 标普500指数,里面是美国最顶尖的500家公司,比如苹果、微软、亚马逊这些巨头。

简单理解就是,你买VOO,其实就是在投资美国最强的一批公司。过去五年平均回报大概在 15%左右,很多人都会把它当作投资组合里的核心资产。

第二个是 QM

它追踪的是 纳斯达克100指数,也就是科技板块。里面有英伟达、苹果、Meta这些科技巨头。

如果你相信未来十年科技还会继续爆发,那QM其实就是在押注科技行业的长期增长。

第三个是 US

US投资的是 美国以外的全球公司。很多人投资只买美国市场,但US可以帮你把资金分散到全球。

如果未来美国市场出现波动,US也能帮你的投资组合降低风险。

简单来说,这三个ETF代表三件事:VOO代表美国核心经济,QM代表科技成长,US代表全球分散。

对于普通投资者来说,很多时候最难的不是选资产,而是 长期坚持投资。

BTC0.82%

- 赞赏

- 2

- 评论

- 转发

- 分享

- 赞赏

- 点赞

- 评论

- 转发

- 分享

加载更多

加入 4000万 人汇聚的头部社区

⚡️ 与 4000万 人一起参与加密货币热潮讨论

💬 与喜爱的头部博主互动

👍 查看感兴趣的内容

热门话题

查看更多34.03万 热度

4997.27万 热度

50.84万 热度

211.61万 热度

18.13万 热度

热门 Gate Fun

查看更多- 市值:$2503.44持有人数:10.00%

- 市值:$2500持有人数:10.00%

- 市值:$2493.1持有人数:10.00%

- 市值:$2493.1持有人数:10.00%

- 市值:$2527.58持有人数:10.00%

快讯

查看更多置顶

Gate Booster 第 4 期:发帖瓜分 1,500 $USDT

🔹 发布 TradFi 黄金福袋原创内容,可得 15 $USDT,名额有限先到先得

🔹 本期支持 X、YouTube 发布原创内容

🔹 无需复杂操作,流程清晰透明

🔹 流程:申请成为 Booster → 领取任务 → 发布原创内容 → 回链登记 → 等待审核及发奖

📅 任务截止时间:03月20日16:00(UTC+8)

立即领取任务:https://www.gate.com/booster/10028?pid=allPort&ch=KTag1BmC

更多详情:https://www.gate.com/announcements/article/50203🤖 寻找 Gate 广场 AI 测评官!$50,000 悬赏令发布!

发帖聊 AI,奖金拿到手软!新人首帖奖励翻倍,单帖最高 200U!

📝 立即报名:https://www.gate.com/questionnaire/7477

1️⃣ 发帖得红包,单帖最高 100U!

2️⃣ Top 体验分享官:带 #Gate广场AI测评官 聊技巧,赢国米球衣!

3️⃣ 收益率 PK 王:晒 AI 收益截图,赢 Gate 定制运动套装!

4️⃣ 深度好文额外加码 30U 每篇张榜公布!

💬 来 Gate 广场,把握行业新趋势:https://www.gate.com/post

时间:3/12 18:00 – 3/27 24:00 (UTC+8)

详情:https://www.gate.com/announcements/article/50206Gate 广场内容挖矿奖励继续升级!无论您是创作者还是用户,挖矿新人还是头部作者都能赢取好礼获得大奖。现在就进入广场探索吧!

创作者享受最高60%创作返佣

创作者奖励加码1500USDT:更多新人作者能瓜分奖池!

观众点击交易组件交易赢大礼!最高50GT等新春壕礼等你拿!

详情:https://www.gate.com/announcements/article/49802