Wie PeerDAS dabei hilft, die „Datenhoheit“ von Ethereum zurückzuerobern

Verfasst von: imToken

Ende 2025 begrüßte die Ethereum-Community relativ ruhig den Abschluss des Fusaka-Updates.

Rückblickend auf das vergangene Jahr sind die Diskussionen über Upgrades der zugrunde liegenden Technologie allmählich aus dem Rampenlicht verschwunden, doch viele On-Chain-Nutzer haben bereits eine deutliche Veränderung gespürt: Ethereum L2 wird immer günstiger.

Heutzutage benötigen Transaktionen auf der Chain, egal ob einfache Überweisungen oder komplexe DeFi-Operationen, oft nur wenige Cent Gas-Gebühren oder sind sogar vernachlässigbar. Hinter diesem Fortschritt stehen das Dencun-Upgrade und die Blob-Mechanik, doch gleichzeitig aktiviert die offizielle PeerDAS (Peer Data Availability Sampling, Peer-to-Peer-Datenverfügbarkeits-Sampling) Funktion im Fusaka-Upgrade, wodurch Ethereum sich endgültig vom Zeitalter der vollständigen Datenüberprüfung verabschiedet.

Man kann sagen, was wirklich darüber entscheidet, ob Ethereum langfristig und nachhaltig große Anwendungen tragen kann, ist nicht nur Blob selbst, sondern vielmehr der nächste Schritt, den PeerDAS repräsentiert.

1. Was ist PeerDAS?

Um die revolutionäre Bedeutung von PeerDAS zu verstehen, dürfen wir nicht nur bei Konzepten verweilen. Es ist notwendig, einen Schlüsselpunkt auf dem Weg der Ethereum-Skalierung zurückzuverfolgen: das Dencun-Upgrade im März 2024.

Damals führte EIP-4844 das Transaktionsmodell mit Blob-Transport ein (bei dem große Mengen an Transaktionsdaten in Blobs eingebettet werden), wodurch L2s nicht mehr auf die teure Calldata-Speicherung angewiesen waren, sondern temporäre Blob-Speicher nutzen konnten.

Diese Änderung senkte die Kosten für Rollups auf ein Zehntel des vorherigen Niveaus, was es den L2-Plattformen ermöglichte, günstigere und schnellere Transaktionen anzubieten, ohne die Sicherheit und Dezentralisierung von Ethereum zu beeinträchtigen. Damit konnten wir Nutzer den Vorteil des „niedrigen Gas-Preis-Zeitalters“ genießen.

Obwohl Blob sehr nützlich ist, gibt es eine harte Obergrenze für die Anzahl der Blobs, die in einem Block auf der Ethereum-Hauptkette verarbeitet werden können (meist 3-6). Der Grund ist sehr pragmatisch: physische Bandbreite und Festplattenkapazität sind begrenzt.

Im traditionellen Validierungsmodus müssen alle Validatoren, egal ob sie von professionellen Institutionen betrieben werden oder private Heimserver nutzen, vollständige Blob-Daten herunterladen und verbreiten, um die Daten auf ihre Gültigkeit zu prüfen.

Dies führt zu einem Dilemma:

- Wenn die Blob-Anzahl erhöht wird (zur Skalierung): Die Datenmenge steigt exponentiell, Heimknoten werden durch Bandbreite und Festplattenplatz überfordert, was sie zum Offline-Gehen zwingt. Das Netzwerk würde schnell zentralisiert, nur noch große Rechenzentren könnten es betreiben.

- Wenn die Blob-Anzahl beschränkt wird (zur Dezentralisierung): Die Transaktionsdurchsatzrate von L2 wird blockiert, was zukünftiges Wachstum unmöglich macht.

Kurz gesagt, Blob ist nur der erste Schritt, der das Problem „Wo speichern?“ löst. Bei geringem Datenvolumen ist alles in Ordnung, doch wenn die Anzahl der Rollups weiter steigt und sie regelmäßig Daten hochfrequent übermitteln, wächst die Blob-Kapazität ständig. Dann könnten Bandbreite und Speicherplatz der Knoten zu neuen Zentralisierungsrisiken werden.

Wenn man weiterhin das traditionelle Voll-Download-Modell nutzt, wird die Skalierung an der physischen Bandbreiten-Grenze scheitern. PeerDAS ist der Schlüssel, um dieses Problem zu lösen.

Kurz gesagt, PeerDAS ist im Wesentlichen eine völlig neue Datenvalidierungsarchitektur, die die starre Regel durchbricht, dass Validierung nur durch vollständigen Download erfolgen kann, und erlaubt die Erweiterung der Blob-Kapazität jenseits der aktuellen physischen Durchsatzgrenzen (z.B. von 6 Blobs/Block auf 48 oder mehr).

2. Blob löst das „Wo speichern“, PeerDAS das „Wie speichern“

Wie oben erwähnt, hat Blob den ersten Schritt in der Skalierung gemacht, indem es das Problem „Wo speichern?“ löst (von teurem Calldata auf temporären Blob-Speicher umgestellt). Das Ziel von PeerDAS ist es nun, das „Wie effizient speichern?“ zu verbessern.

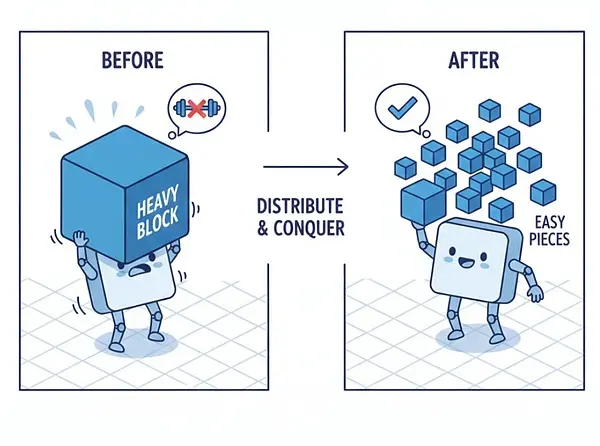

Das zentrale Problem ist, wie man bei exponentiellem Datenwachstum die physische Bandbreite der Knoten nicht überfordert. Die Lösung ist recht simpel: Basierend auf Wahrscheinlichkeit und verteiltem Zusammenwirken „muss nicht jeder alle Daten speichern, um mit hoher Wahrscheinlichkeit zu bestätigen, dass diese Daten wirklich existieren.“

Dieses Konzept lässt sich anhand des vollständigen Namens von PeerDAS „Peer-to-Peer-Datenverfügbarkeits-Sampling“ gut erklären.

Der Begriff klingt komplex, doch wir können eine einfache Analogie verwenden: Früher war die vollständige Validierung vergleichbar mit einer Bibliothek, die ein 3000-seitiges „Enzyklopädie Britannica“ (Blob-Daten) besitzt. Um Datenverlust zu vermeiden, musste jeder Bibliothekar (Knoten) eine vollständige Kopie des Buches anfertigen.

Das bedeutete, nur wohlhabende und bandbreitenstarke Personen konnten Bibliothekare sein, vor allem, weil die Enzyklopädie ständig wächst. Mit der Zeit würde die Masse der Nutzer ausgeschlossen, die Dezentralisierung würde verloren gehen.

Mit PeerDAS und Techniken wie Erasure Coding wird das Ganze nun sozusagen „zerrissen“: Das Buch wird in unzählige Fragmente zerlegt und mathematisch codiert. Jeder Bibliothekar muss nicht mehr das ganze Buch besitzen, sondern nur noch zufällig ausgewählte Seiten.

Selbst bei der Validierung ist es nicht notwendig, das ganze Buch vorzulegen. Theoretisch reicht es, wenn im Netzwerk 50% der Fragmente zufällig zusammenkommen (egal ob jemand Seite 10 oder Seite 100 hat). Mit mathematischen Algorithmen kann man dann das vollständige Buch mit 100%iger Sicherheit rekonstruieren.

Das ist die Magie von PeerDAS — die Last des Daten-Downloads wird von einzelnen Knoten auf das gesamte Netzwerk verteilt, auf Tausende von Knoten.

Quelle: @Maaztwts

Quelle: @Maaztwts

Allein aus einer intuitiven Datenperspektive: Vor Fusaka war die Blob-Anzahl fest auf 3-6 beschränkt. Mit PeerDAS kann diese Obergrenze auf 48 oder mehr erhöht werden.

Wenn Nutzer auf Arbitrum oder Optimism eine Transaktion starten und die Daten an die Hauptkette zurückgesendet werden, ist keine vollständige Datenübertragung mehr notwendig. Das macht die Skalierung von Ethereum deutlich effizienter, da die Kosten für das Hochladen von Daten nicht mehr linear mit der Knotenzahl steigen.

Objektiv betrachtet sind Blob + PeerDAS die vollständige Data Availability (Datenverfügbarkeits-) Lösung. Aus Sicht der Roadmap ist dies der entscheidende Übergang von Proto-Danksharding zu vollständigem Danksharding.

3. Neue Normalität auf der Chain nach Fusaka

Es ist allgemein bekannt, dass in den letzten Jahren Drittanbieter wie Celestia mit modularen Data-Availability-Schichten aufgrund der hohen Kosten auf der Ethereum-Hauptkette große Marktanteile gewonnen haben. Ihre Erzählung basiert auf der Prämisse, dass die native Datenspeicherung von Ethereum teuer ist.

Mit Blob und PeerDAS wird Ethereum jetzt günstiger und gleichzeitig extrem sicher: Die Kosten für L2, Daten an L1 zu senden, sind halbiert, und Ethereum verfügt mit den größten Validatoren-Netzwerken über eine Sicherheit, die Third-Party-Blockchains weit übertrifft.

Objektiv gesehen ist das für Drittanbieter wie Celestia eine deutliche Abwertung, ein „Dimensionalitäts-Reduktion“-Schlag. Es zeigt, dass Ethereum die Kontrolle über die Datenverfügbarkeit zurückerobert und ihre Marktposition stärkt, was den Wettbewerb erheblich einschränkt.

Man könnte fragen: Das klingt alles sehr technisch. Was hat das mit Wallets, Überweisungen oder DeFi zu tun?

Die Verbindung ist sehr direkt. Wenn PeerDAS erfolgreich implementiert wird, bedeutet das, dass die Datenkosten für L2 langfristig niedrig bleiben. Rollups müssen keine hohen DA-Kosten mehr fürchten, und On-Chain-Anwendungen können Hochfrequenz-Interaktionen ohne ständiges Kosten-Dilemma entwickeln. Wallets und DApps müssen nicht mehr zwischen „Funktionalität und Kosten“ abwägen…

Kurz gesagt, die günstigen L2s, die wir heute nutzen, sind das Verdienst von Blob. Wenn wir sie auch in Zukunft nutzen können, ist PeerDAS der stille Held dahinter.

Deshalb ist PeerDAS in der Ethereum-Entwicklung zwar eher unauffällig, aber stets als unverzichtbarer Schritt angesehen. Im Kern ist es die beste technische Lösung — „Nutzen, ohne es zu merken; Verlieren, wenn es weg ist“ — und es macht seine Existenz kaum spürbar.

Letztlich beweist PeerDAS, dass Blockchains durch raffinierte mathematische Designs (wie Sampling) in der Lage sind, Web2-ähnliche Datenmengen zu tragen, ohne die Dezentralisierung zu gefährden.

Damit ist die Datenautobahn von Ethereum vollständig ausgebaut. Was auf dieser Straße fährt, ist die nächste Frage, die die Anwendungsebene beantworten muss.

Wir dürfen gespannt sein.

Verwandte Artikel

Ethereum-Gebühren auf Rekordtief! Durchschnittlich weniger als 0,1 USD, L2-Skalierung tritt in eine Zeit extrem niedriger Gebühren ein

SharpLink bilanzieller Verlust von 734 Millionen USD: ETH-Staking-Geschäft erreicht historischen Höchststand, Institutionen erhöhen ihre Investitionen

Bitmine transferiert 9600 ETH an die institutionelle Plattform, möglicherweise für internes Asset-Rebalancing, Staking oder OTC-Handel

Bitmine Wallet hat heute 9257 ETH an eine CEX übertragen, im Wert von 18,79 Millionen US-Dollar

Vorsicht vor Krypto-Betrug: Politische Organisationen behaupten, dass jemand im Namen Spenden für Bitcoin, Ethereum sammelt, im Zusammenhang mit Iran-Themen