AIモデルの急速な発展により、世界中でGPU需要が急増しています。大規模言語モデル(LLM)、AIエージェント、オートメーションアプリケーションの拡大に伴い、従来の中央集権型AIクラウドプラットフォームは、高コストやリソース集中、スケーラビリティの課題に直面しています。このような状況下で、分散型GPUネットワークがWeb3 AIインフラの主要な方向性として台頭しています。

Dolphin Networkは、この流れに対応して開発されたAI推論ネットワークです。主な目的は、グローバルに分散したGPUリソースをオープンなAIインフラとして集約し、PODインセンティブメカニズムによってデベロッパー、GPUノード、ネットワークを調和させることです。

Dolphin Networkのコア構造とは?

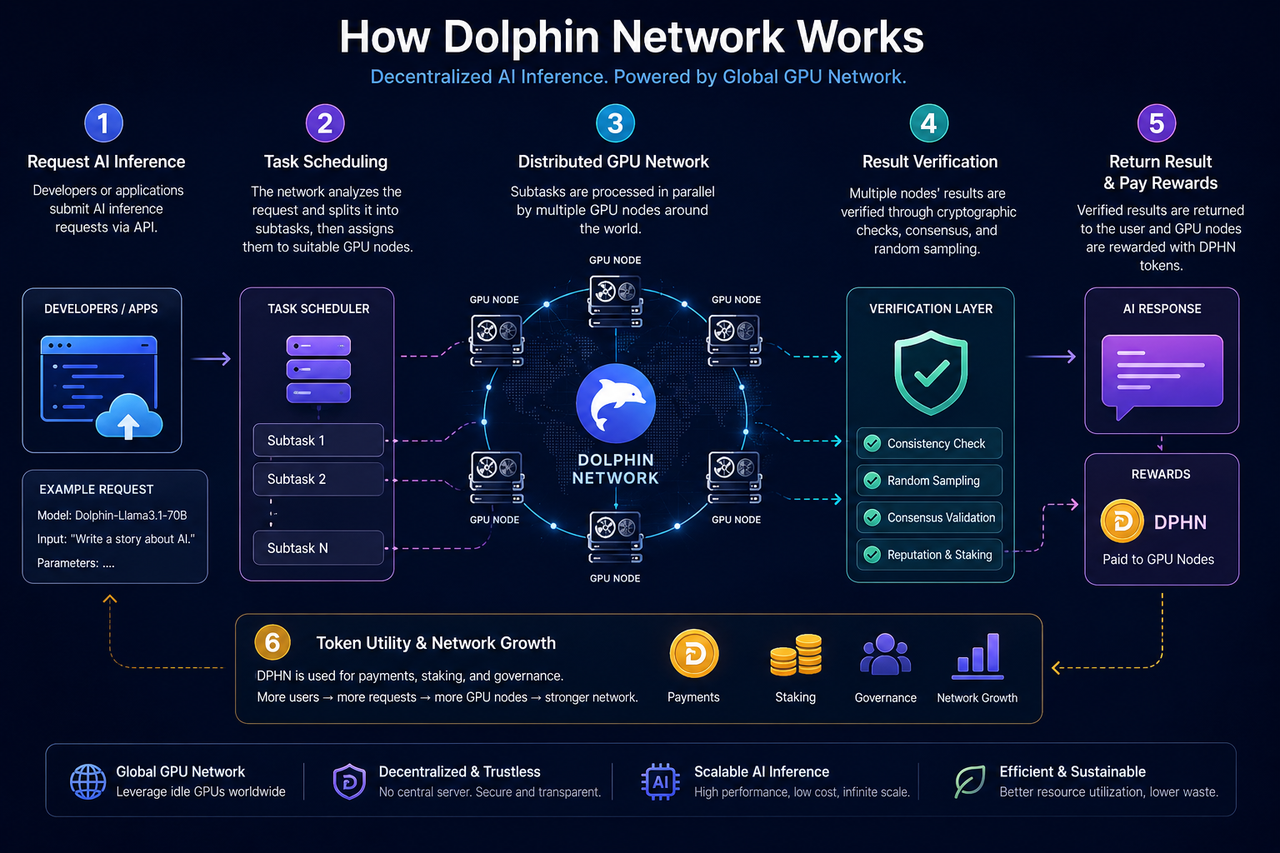

Dolphin Networkのコアアーキテクチャは、AI推論リクエスター、GPUノードネットワーク、検証・協調メカニズムの3要素で構成されています。

デベロッパーやアプリケーションは、テキスト生成、チャット推論、モデル呼び出し、AIエージェントタスクなどのAI推論リクエストをネットワークに提出できます。システムは、GPUノードのステータス、タスク要件、リソースの利用可能状況に応じてリクエストを動的に適切なノードに割り当てます。

GPUノードは世界中のユーザーによって提供されています。参加者はアイドル状態のGPUをネットワークに接続し、ローカルで推論タスクを実行することで、貢献度に応じてトークン報酬を獲得できます。

結果の整合性を確保するため、Dolphinは検証メカニズムと経済的インセンティブを組み合わせてノードの行動を調整します。これにはランダムサンプリング、タスクレビュー、ステーキングシステムが含まれます。

AI推論リクエストはどのようにネットワークに入るのか?

デベロッパーがDolphin Networkとやり取りする際、リクエストは最初にタスクスケジューリング層にルーティングされます。

この層では、タスクの種類、GPU要件、モデルリソースを分析します。AIモデルによって必要なメモリ構成や推論速度、計算能力が異なるため、ネットワークはノードのステータスに応じてリクエストを動的にマッチングします。

中央集権型AIクラウドプラットフォームでは、このプロセスは単一のデータセンターで処理されますが、Dolphinではタスクが分散型GPUノードネットワーク全体に配分されます。

一部のタスクは、効率やネットワークの同時処理能力向上のため、複数の小さな推論リクエストに分割される場合もあります。

GPUノードはAI推論タスクをどのように処理するのか?

GPUノードはDolphin Networkの主要な計算リソースです。

ノード運用者は指定のソフトウェアをデプロイし、システムがローカルGPUをAI推論タスクに利用できるようにします。タスクが割り当てられると、ノードは関連モデルや推論パラメータをダウンロードし、ローカルで計算を実行します。

完了後、ノードは推論結果をネットワークへ提出し、結果の有効性を確認するための検証を待ちます。検証を通過したタスクのみがトークン報酬の対象となります。

この仕組みは従来のGPUマイニングとは異なります。PoWネットワークがハッシュ計算を行うのに対し、DolphinのGPUノードは実際のAI推論タスクを実行するため、「利用可能なハッシュパワーマーケットプレイス」に近い構造となっています。

DolphinはAI推論結果をどのように検証するのか?

AI推論は、標準的なブロックチェーントランザクションのように単純な数式で検証できないことが多いため、Dolphinはノードによる誤った結果提出を防ぐための追加メカニズムを採用しています。

代表的な手法はランダムサンプリングです。タスクをランダムで選び、複数ノード間で結果の一貫性を確認します。異常なデータを継続的に提出した場合、ノードの評価が下がる、または報酬資格を失うことがあります。

一部の分散型AIネットワークでは、ステーキングも導入されています。ノードは参加のためにトークンをステーキングし、不正行為があればステーキングした資産にペナルティが科されます。

これらの経済的インセンティブはノード行動の整合性を図り、ネットワークの信頼性向上に寄与します。

Dolphinは従来のAIクラウド推論とどう異なるのか?

従来のAIクラウドプラットフォームは、主に大規模な中央集権型データセンターに依存し、単一の事業体がGPUクラスターやモデルデプロイ、APIサービスを管理します。

DolphinはオープンなGPUネットワークアーキテクチャを採用しています。GPUノードはグローバルなユーザーによって提供されており、デベロッパーはよりオープンな環境でAI推論サービスを利用でき、単一プロバイダーへの依存を軽減できます。

また、DolphinはオープンAIモデルやリソース共有にも注力しています。ネットワークによっては、オープンソースモデルのデプロイやカスタムルール、オープンなAIエージェントシナリオをサポートしています。

ただし、分散型AIネットワークは安定性やネットワーク遅延、ノード品質のばらつきなどの課題も抱えており、現時点では発展段階にあります。

Dolphin Networkが直面する課題は?

分散型AI推論ネットワークは、オープン性やリソース共有といった利点を持つ一方で、いくつかの実務的課題にも直面しています。

まず、GPUノードの性能には大きな差があります。ハードウェアのメモリや帯域幅、推論能力の違いがネットワーク全体の安定性に影響します。

次に、AI推論結果の検証は依然として複雑です。ブロックチェーントランザクションと異なり、AI出力は確率的であり、検証コストが増大します。

AIモデルが大規模化する中、分散環境で大規模GPUクラスターを効率的にスケジューリングすることは、AI DePINプロジェクトにとって重要な課題です。

また、規制の不確実性も課題です。オープンAIモデルはデータや著作権、コンテンツ生成に関する懸念を招く可能性があり、AIインフラネットワークは長期的な規制リスクに対応する必要があります。

まとめ

Dolphin Networkは、AIとDePINを融合した分散型AI推論ネットワークであり、グローバルなGPUノードを活用してオープンなAIインフラの構築を目指しています。ネットワークは、タスクスケジューリング、分散推論、ランダム検証、DPHNインセンティブメカニズムを通じて、デベロッパーとGPUノードを調和させます。

従来の中央集権型AIクラウドプラットフォームと比較し、Dolphinはオープン性、リソース共有、検閲耐性を重視し、Web3 AIインフラの主要な方向性として位置付けられています。

よくある質問

DolphinはGPUノードをどのように活用していますか?

GPUホルダーはノードをデプロイし、アイドル状態のGPUリソースを提供してAI推論タスクを実行し、DPHN報酬を獲得できます。

DolphinのAI推論プロセスにはどのようなステップがありますか?

主なステージは、タスク提出、ノードスケジューリング、GPU推論実行、結果検証、報酬分配です。

DolphinがDePINプロジェクトとされる理由は?

コアリソースが実世界のGPUハードウェアであり、トークンベースのインセンティブによって分散型インフラを調整しています。

Dolphinは従来のAIクラウドプラットフォームとどう異なりますか?

従来のAIクラウドプラットフォームは中央集権型データセンターに依存しますが、DolphinはオープンなGPUネットワークを活用して分散型AI推論サービスを提供します。

ネットワーク内でのDPHNの役割は何ですか?

DPHNはAI推論の支払い、ノード報酬、ステーキング、ネットワーク内の経済的インセンティブとして使用されます。

関連記事

ONDOトークン経済モデル:プラットフォームの成長とユーザーエンゲージメントをどのように推進するのか

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

0xプロトコルの主要コンポーネントは何でしょうか。Relayer、Mesh、APIアーキテクチャの概要をご紹介します。

Plasma(XPL)トークノミクス分析:供給、分配、価値捕捉