crypto花椒

用戶暫無簡介

crypto花椒

Generalist AI的GEN-1來了——機器人真的會幹活了

GTC 2026上,兩個機械臂自主完成手機包裝

NVIDIA做機器人的"安卓",Generalist做"應用層"靈巧操作模型,Universal Robots提供硬體。

和Figure、Tesla Bot不一樣。Generalist純做模型,接入別人硬體。輕資產、快迭代。

2026年是通用機器人分水嶺。不是因為demo驚艷,是供應鏈成形了:晶片+模型+硬體+場景,四層都有人在做

我們正在一個超級大時代!

查看原文GTC 2026上,兩個機械臂自主完成手機包裝

NVIDIA做機器人的"安卓",Generalist做"應用層"靈巧操作模型,Universal Robots提供硬體。

和Figure、Tesla Bot不一樣。Generalist純做模型,接入別人硬體。輕資產、快迭代。

2026年是通用機器人分水嶺。不是因為demo驚艷,是供應鏈成形了:晶片+模型+硬體+場景,四層都有人在做

我們正在一個超級大時代!

- 打賞

- 按讚

- 留言

- 轉發

- 分享

一篇论文让我停下来看了半小时 S0 Tuning

核心idea:不改模型权重,只调一个初始状态矩阵,就能大幅提升模型coding能力。

在Qwen3.5-4B上,只用48个HumanEval训练样本(不是48K,是48个),S0 tuning把pass@1提升了23.6个百分点。

对比LoRA,S0高了10.8个百分点。p值<0.001,统计显著。

在FalconH1-7B上,S0达到71.8%。

这意味调完之后模型速度不变,大小不变,只是"起跑位置"更好了。

对做本地模型部署的人来说,这打开了一扇门:拿一个通用模型,用几十个领域样本把它调成专用模型,不付任何性能代价。

论文在arxiv: 2604.01168。做模型适配的人应该读一下

核心idea:不改模型权重,只调一个初始状态矩阵,就能大幅提升模型coding能力。

在Qwen3.5-4B上,只用48个HumanEval训练样本(不是48K,是48个),S0 tuning把pass@1提升了23.6个百分点。

对比LoRA,S0高了10.8个百分点。p值<0.001,统计显著。

在FalconH1-7B上,S0达到71.8%。

这意味调完之后模型速度不变,大小不变,只是"起跑位置"更好了。

对做本地模型部署的人来说,这打开了一扇门:拿一个通用模型,用几十个领域样本把它调成专用模型,不付任何性能代价。

论文在arxiv: 2604.01168。做模型适配的人应该读一下

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Google放了Gemma 4

1B、13B、27B三個尺寸,還有31B稠密版。全部Apache 2.0協議。商用隨便用。

這個license變化比模型本身重要。之前Gemma用的是Google自家協議,有限制。現在Apache 2.0,和Meta的Llama直接競爭。

模型本身的亮點:多模態——文本+視覺+音頻。31B稠密版在AIME 2026上跑了89.2%,LiveCodeBench v6拿了80%,Codeforces ELO 2150。

27B參數量對本地部署很友好。一張4090能跑。

E4B和E2B是端側版本,給手機和IoT用的。Google在鋪Gemini Nano 4的生態。

Llama在開源LLM圈子裡一家獨大太久了。Google這次不是試水,是全面進攻——覆蓋從2B到31B全參數段,Apache協議不設商用門檻,端雲一體。

對獨立開發者和小團隊來說這是好消息。競爭越激烈,免費午餐越多。

對Meta來說,Llama的護城河在收窄。

查看原文1B、13B、27B三個尺寸,還有31B稠密版。全部Apache 2.0協議。商用隨便用。

這個license變化比模型本身重要。之前Gemma用的是Google自家協議,有限制。現在Apache 2.0,和Meta的Llama直接競爭。

模型本身的亮點:多模態——文本+視覺+音頻。31B稠密版在AIME 2026上跑了89.2%,LiveCodeBench v6拿了80%,Codeforces ELO 2150。

27B參數量對本地部署很友好。一張4090能跑。

E4B和E2B是端側版本,給手機和IoT用的。Google在鋪Gemini Nano 4的生態。

Llama在開源LLM圈子裡一家獨大太久了。Google這次不是試水,是全面進攻——覆蓋從2B到31B全參數段,Apache協議不設商用門檻,端雲一體。

對獨立開發者和小團隊來說這是好消息。競爭越激烈,免費午餐越多。

對Meta來說,Llama的護城河在收窄。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

OpenAI花錢買了一個YouTube talk show。

TBPN,一個2025年才開始做的科技直播節目,YouTube粉絲才5.8萬。OpenAI把它收購了。

TBPN去年廣告收入500萬美金。今年預計破3000萬。是一個不到兩歲的節目,增長6倍。

節目每天下午2點直播3小時,嘉賓名單是這樣的:Sam Altman、Meta高管、微軟高管、Palantir、a16z。Bloomberg和CNBC都來過。

這是硅谷權力圈的客廳。

收購後TBPN歸OpenAI戰略部門管,匯報給首席政治官Chris Lehane。注意這個職稱——政治官,不是內容官。

OpenAI說會保持編輯獨立。但一個AI公司買下自己CEO常上的節目,“獨立”這兩個字能信幾分,自己判斷。

當AI競爭白熱化,技術差距在縮小的時候,誰控制敘事誰就贏。Google有搜索,Meta有社交圖譜,OpenAI什麼都沒有。

買TBPN不是買內容,是買分發渠道+輿論陣地

查看原文TBPN,一個2025年才開始做的科技直播節目,YouTube粉絲才5.8萬。OpenAI把它收購了。

TBPN去年廣告收入500萬美金。今年預計破3000萬。是一個不到兩歲的節目,增長6倍。

節目每天下午2點直播3小時,嘉賓名單是這樣的:Sam Altman、Meta高管、微軟高管、Palantir、a16z。Bloomberg和CNBC都來過。

這是硅谷權力圈的客廳。

收購後TBPN歸OpenAI戰略部門管,匯報給首席政治官Chris Lehane。注意這個職稱——政治官,不是內容官。

OpenAI說會保持編輯獨立。但一個AI公司買下自己CEO常上的節目,“獨立”這兩個字能信幾分,自己判斷。

當AI競爭白熱化,技術差距在縮小的時候,誰控制敘事誰就贏。Google有搜索,Meta有社交圖譜,OpenAI什麼都沒有。

買TBPN不是買內容,是買分發渠道+輿論陣地

- 打賞

- 按讚

- 留言

- 轉發

- 分享

阿里悄悄放了個大招。

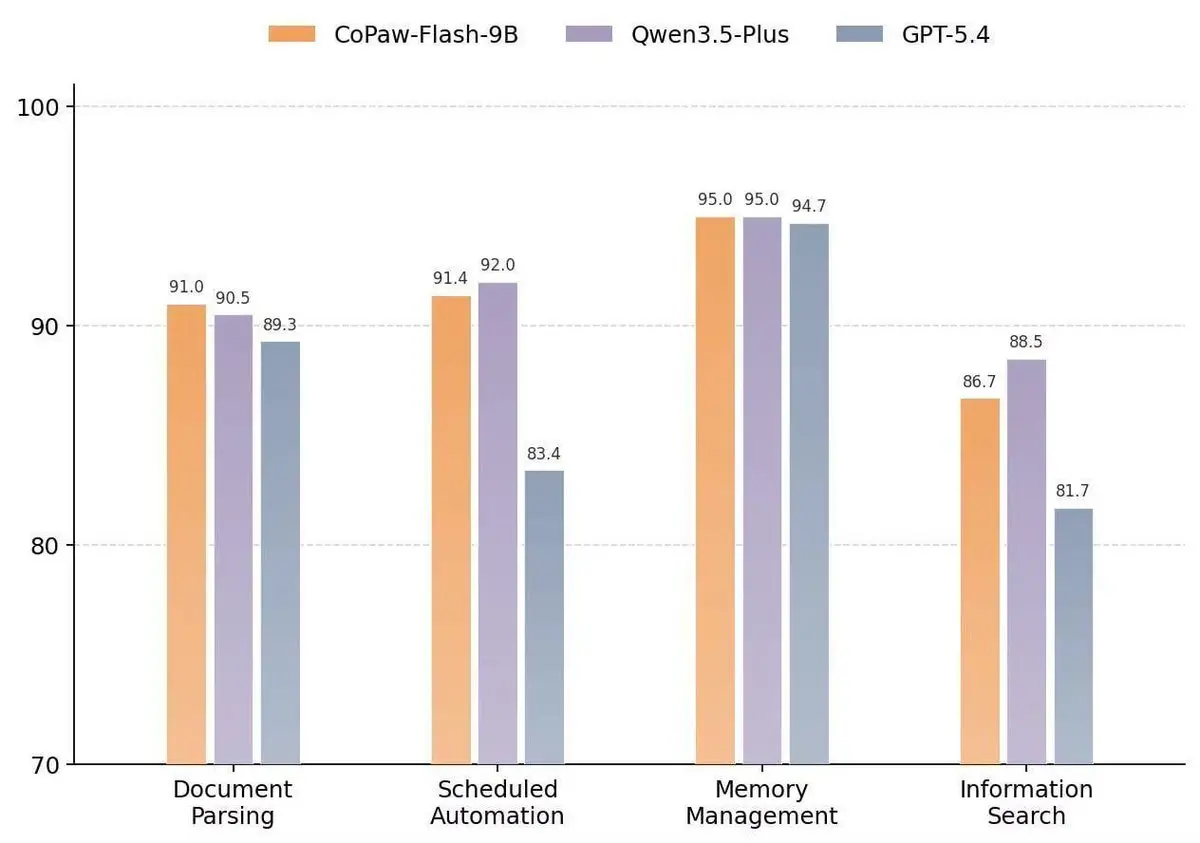

CoPaw-Flash-9B——基於Qwen3.5的AI Agent模型。9B參數,能跑在你自己電腦上。

厲害在哪?

部分benchmark和Qwen3.5-Plus(閉源大模型)打平了。

90億參數 vs 幾百億參數,分數差不多。

更讓我興奮的是CoPaw這個框架:

- 支持持久記憶(聊過的它記得)

- 多渠道連接(、飛書、Discord都能接)

- 本地部署,不用API費用

Qwen3.5的架構也很猛——總參數397B,每個token只激活17B。效率拉滿。

你不需要H100伺服器。一台MacBook可能就夠跑一個個人AI助手了。

我在想把我內容pipeline的一些中間步驟(資料清洗、格式轉換)挪到本地模型上,API費用能省一大半。

2026下半年,個人AI Agent可能會變成標配。

不過benchmark分數和實際體驗是兩回事。等我本地跑通了再說。

查看原文CoPaw-Flash-9B——基於Qwen3.5的AI Agent模型。9B參數,能跑在你自己電腦上。

厲害在哪?

部分benchmark和Qwen3.5-Plus(閉源大模型)打平了。

90億參數 vs 幾百億參數,分數差不多。

更讓我興奮的是CoPaw這個框架:

- 支持持久記憶(聊過的它記得)

- 多渠道連接(、飛書、Discord都能接)

- 本地部署,不用API費用

Qwen3.5的架構也很猛——總參數397B,每個token只激活17B。效率拉滿。

你不需要H100伺服器。一台MacBook可能就夠跑一個個人AI助手了。

我在想把我內容pipeline的一些中間步驟(資料清洗、格式轉換)挪到本地模型上,API費用能省一大半。

2026下半年,個人AI Agent可能會變成標配。

不過benchmark分數和實際體驗是兩回事。等我本地跑通了再說。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

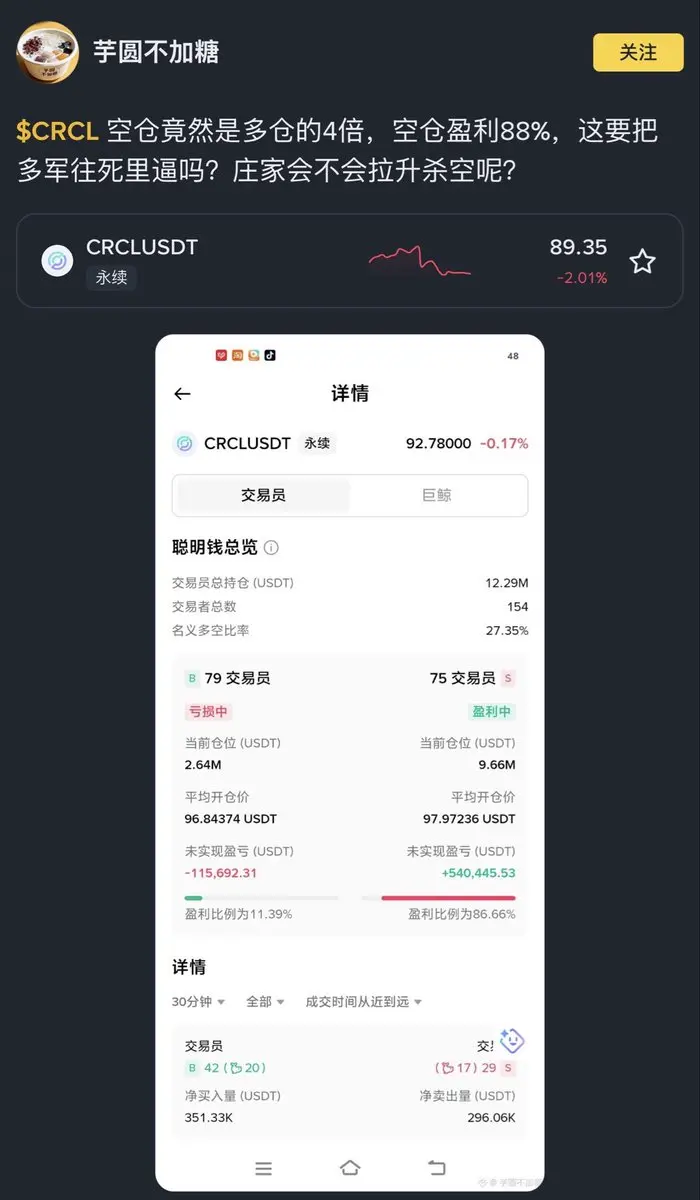

這個市場就是被這種MM搅局最後死亡的

一天拉18倍 然後 15分鐘結束戰鬥

縱然是上了bn的合約/現貨 也是難逃命運

沒有任何info edge的散戶只會死得更快

山寨完了 加密完了

查看原文一天拉18倍 然後 15分鐘結束戰鬥

縱然是上了bn的合約/現貨 也是難逃命運

沒有任何info edge的散戶只會死得更快

山寨完了 加密完了

- 打賞

- 按讚

- 留言

- 轉發

- 分享

刷到一張"AI工具大全"的圖,分了十幾個類,看著特別牛。

說個暴論- 你根本不需要那麼多工具。

我每天真正打開的就三個:

- Claude:寫程式碼+寫長文 + 讓他認識我

- Codex: 瞎幹搞

偶爾用到的再加三個:google stitch做圖,Whisper轉錄,Claude artifact做資料分析。

五個。夠了。

那張圖的問題在哪?它把"存在"當成了"有用"。三個AI寫作工具,Claude一個就替了。三個AI畫圖工具,google stitch/一個就夠。

選工具的邏輯:

別問"市面上有什麼"

要問"我每天重複做的事,AI能幫哪件"

從痛點出發找工具,別從工具清單出發找痛點。

我見過太多人——Notion AI付了費沒打開過,Jasper訂了一年寫了三篇。

工具不是越多越好。夠用就行。

查看原文說個暴論- 你根本不需要那麼多工具。

我每天真正打開的就三個:

- Claude:寫程式碼+寫長文 + 讓他認識我

- Codex: 瞎幹搞

偶爾用到的再加三個:google stitch做圖,Whisper轉錄,Claude artifact做資料分析。

五個。夠了。

那張圖的問題在哪?它把"存在"當成了"有用"。三個AI寫作工具,Claude一個就替了。三個AI畫圖工具,google stitch/一個就夠。

選工具的邏輯:

別問"市面上有什麼"

要問"我每天重複做的事,AI能幫哪件"

從痛點出發找工具,別從工具清單出發找痛點。

我見過太多人——Notion AI付了費沒打開過,Jasper訂了一年寫了三篇。

工具不是越多越好。夠用就行。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

我們都是用的claude codex

你用minimax GLM qwen怕是找不到朋友哦

查看原文你用minimax GLM qwen怕是找不到朋友哦

- 打賞

- 按讚

- 留言

- 轉發

- 分享

一個正在跟OpenAI打官司的人說不信任OpenAI。

一個自己也搞AI(xAI)的人說不信任競爭對手。

Musk說的每句關於OpenAI的話,都要乘以一個「利益衝突系數」。

不是說他說的一定是錯的。OpenAI確實有很多值得質疑的地方。

但Musk是最沒資格做中立評價的人。

查看原文一個自己也搞AI(xAI)的人說不信任競爭對手。

Musk說的每句關於OpenAI的話,都要乘以一個「利益衝突系數」。

不是說他說的一定是錯的。OpenAI確實有很多值得質疑的地方。

但Musk是最沒資格做中立評價的人。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

有人用Transformer來判斷程式碼裡的迴圈能不能並行化了。

聽起來很學術?別急。

先說背景。

寫程式的人都知道,把一個for迴圈改成並行執行是性能優化的聖杯。但問題是:改錯了就出bug。傳統方法靠靜態分析,但遇到複雜的依賴關係就歇菜了。

這篇論文幹了一件事:把程式碼塞進Transformer模型(對,就是GPT那個架構),讓AI來判斷「這個迴圈能不能安全地並行跑」。

為什麼這個方向有意思。

傳統的並行化分析工具已經發展了幾十年了,但準確率在複雜場景下還是不夠。多面體模型搞不定動態結構的程式碼。

Transformer的優勢在於它能捕捉程式碼裡的長距離依賴關係。一個變數在迴圈的第3行被修改,在第47行被讀取——這種跨距離的資料流關係,對Transformer來說是天然的注意力機制問題。

但我想說的不是這篇論文本身。我想說的是趨勢。

AI正在從「幫你寫程式碼」進化到「幫你優化程式碼的底層執行方式」。這是完全不同的層級。

寫程式是替代程式設計師的手。優化執行是替代編譯器工程師的腦。

當AI能判斷哪些程式碼可以並行、哪些不行的時候,下一步就是自動改寫。

說白了——AI不只是在學寫程式碼,它在學理解程式碼。

對開發者來說,這是好事。你寫的爛迴圈,AI幫你優化。

對編譯器團隊來說,這是威脅。你的核心技能正在被模型化。

vibe coder的時代越來越近了。 人類被淘汰進行時

查看原文聽起來很學術?別急。

先說背景。

寫程式的人都知道,把一個for迴圈改成並行執行是性能優化的聖杯。但問題是:改錯了就出bug。傳統方法靠靜態分析,但遇到複雜的依賴關係就歇菜了。

這篇論文幹了一件事:把程式碼塞進Transformer模型(對,就是GPT那個架構),讓AI來判斷「這個迴圈能不能安全地並行跑」。

為什麼這個方向有意思。

傳統的並行化分析工具已經發展了幾十年了,但準確率在複雜場景下還是不夠。多面體模型搞不定動態結構的程式碼。

Transformer的優勢在於它能捕捉程式碼裡的長距離依賴關係。一個變數在迴圈的第3行被修改,在第47行被讀取——這種跨距離的資料流關係,對Transformer來說是天然的注意力機制問題。

但我想說的不是這篇論文本身。我想說的是趨勢。

AI正在從「幫你寫程式碼」進化到「幫你優化程式碼的底層執行方式」。這是完全不同的層級。

寫程式是替代程式設計師的手。優化執行是替代編譯器工程師的腦。

當AI能判斷哪些程式碼可以並行、哪些不行的時候,下一步就是自動改寫。

說白了——AI不只是在學寫程式碼,它在學理解程式碼。

對開發者來說,這是好事。你寫的爛迴圈,AI幫你優化。

對編譯器團隊來說,這是威脅。你的核心技能正在被模型化。

vibe coder的時代越來越近了。 人類被淘汰進行時

- 打賞

- 1

- 留言

- 轉發

- 分享

2970億美金。一個季度。

Q1全球VC融資破紀錄了,比去年同期漲150%。

四家公司拿走了65%——OpenAI 1220億、Anthropic 300億、xAI 200億、Waymo 160億。

AI佔了總融資的81%。

區別是這次的頭部更集中。四家吃掉大半個市場。

錢都去AI了

查看原文Q1全球VC融資破紀錄了,比去年同期漲150%。

四家公司拿走了65%——OpenAI 1220億、Anthropic 300億、xAI 200億、Waymo 160億。

AI佔了總融資的81%。

區別是這次的頭部更集中。四家吃掉大半個市場。

錢都去AI了

- 打賞

- 2

- 留言

- 轉發

- 分享

Spec-heavy, code-light 是正確的架構選擇

什麼harness engineer 說白了就是你的上下文不夠詳細,大多數人根本就不知道自己要細緻的規劃什麼

我的黑客松項目 (讓你雇佣一隻AI求職團隊)已經回爐重做了V2了

我寫了18個spec,接近16個skills,中文的招聘平台 + 英文的招聘平台每一個都testing + 拿到真實實驗數據後才開始操刀

天天看你們發這個那個的,自己完整的跑過嗎?

查看原文什麼harness engineer 說白了就是你的上下文不夠詳細,大多數人根本就不知道自己要細緻的規劃什麼

我的黑客松項目 (讓你雇佣一隻AI求職團隊)已經回爐重做了V2了

我寫了18個spec,接近16個skills,中文的招聘平台 + 英文的招聘平台每一個都testing + 拿到真實實驗數據後才開始操刀

天天看你們發這個那個的,自己完整的跑過嗎?

- 打賞

- 1

- 留言

- 轉發

- 分享

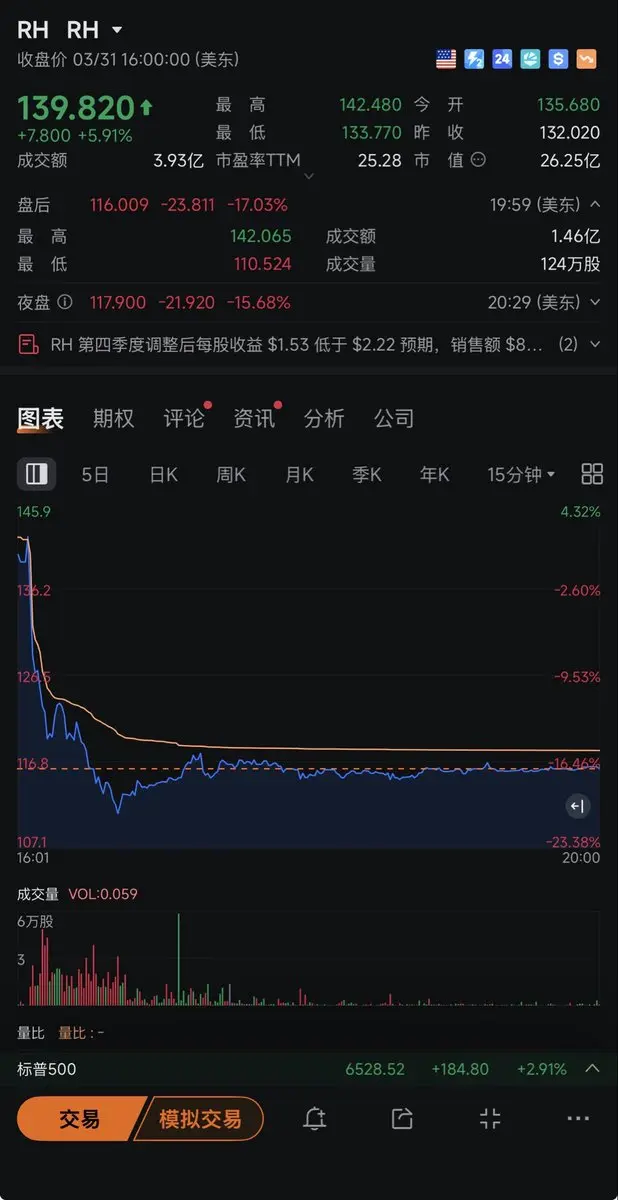

RH股價一夜砍19.5%。

這個以前叫Restoration Hardware的奢侈家具品牌,昨晚財報全線miss。

數字很難看:

營收$8.43億,比預期少了3.6%。EPS $1.53,比預期低了30.6%。下季度指引$7.895億,比分析師預期低10.2%。

股價從$141直接砍到$114。

公司給了兩個理由:關稅導致供應鏈重新採購,影響了$3000萬營收。季末壞天氣又打掉了$1000萬。

但說白了,這些都是藉口。

真正的問題是:奢侈品消費在降溫。

RH賣的是什麼?$5000的沙發、$3000的餐桌、$800的台燈。這類大件消費對利率極度敏感。

美國現在房貸利率6.5%+,誰在這個時候換家具?

更深層的邏輯——RH的商業模式是"membership+showroom"。你付$175年費成為會員,才能享受"25%折扣"。

聽著耳熟嗎?掐頭。

他們的Gallery門店(就是那些巨大的展廳)租金極高。高固定成本意味著對營收極度敏感——稍微下滑,利潤就崩。

查看原文這個以前叫Restoration Hardware的奢侈家具品牌,昨晚財報全線miss。

數字很難看:

營收$8.43億,比預期少了3.6%。EPS $1.53,比預期低了30.6%。下季度指引$7.895億,比分析師預期低10.2%。

股價從$141直接砍到$114。

公司給了兩個理由:關稅導致供應鏈重新採購,影響了$3000萬營收。季末壞天氣又打掉了$1000萬。

但說白了,這些都是藉口。

真正的問題是:奢侈品消費在降溫。

RH賣的是什麼?$5000的沙發、$3000的餐桌、$800的台燈。這類大件消費對利率極度敏感。

美國現在房貸利率6.5%+,誰在這個時候換家具?

更深層的邏輯——RH的商業模式是"membership+showroom"。你付$175年費成為會員,才能享受"25%折扣"。

聽著耳熟嗎?掐頭。

他們的Gallery門店(就是那些巨大的展廳)租金極高。高固定成本意味著對營收極度敏感——稍微下滑,利潤就崩。

- 打賞

- 1

- 留言

- 轉發

- 分享

88%的企業出過AI agent安全事故。但只有22%把agent當"身份"來管。

Okta CEO Todd McKinnon上了The Verge,說了一件讓我注意的事:

AI agent不該只是工具,它應該有自己的身份。像員工一樣登入、鑑權、留日誌。

背景是這樣的。

現在企業裡的AI agent越來越多,能自己訪問資料庫、調API、發郵件。但大多數公司管agent的方式還是——用創建者的帳號權限。

這意味著什麼?agent出了事,你根本不知道是誰讓它做的,做了什麼,什麼時候做的。

McKinnon的邏輯是:agent需要獨立身份、獨立權限、獨立日誌,還需要一個kill switch。一旦agent行為異常,一鍵關停。

我判斷agent identity會成為2026年下半年企業AI的核心話題。

誰先把這個基礎設施做好,誰就是下一輪AI基建的收費站

查看原文Okta CEO Todd McKinnon上了The Verge,說了一件讓我注意的事:

AI agent不該只是工具,它應該有自己的身份。像員工一樣登入、鑑權、留日誌。

背景是這樣的。

現在企業裡的AI agent越來越多,能自己訪問資料庫、調API、發郵件。但大多數公司管agent的方式還是——用創建者的帳號權限。

這意味著什麼?agent出了事,你根本不知道是誰讓它做的,做了什麼,什麼時候做的。

McKinnon的邏輯是:agent需要獨立身份、獨立權限、獨立日誌,還需要一個kill switch。一旦agent行為異常,一鍵關停。

我判斷agent identity會成為2026年下半年企業AI的核心話題。

誰先把這個基礎設施做好,誰就是下一輪AI基建的收費站

- 打賞

- 1

- 留言

- 轉發

- 分享

半小時後 BN廣場見! 可以先預約

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

數據拉一下:

Morgan Stanley MSBT:0.14%

Grayscale Mini Trust:0.15%

Franklin Templeton EZBC:0.19%

Bitwise / VanEck:0.20%

BlackRock IBIT:0.25%

IBIT目前是$840億BTC現貨ETF市場的絕對龍頭。Morgan Stanley用0.14%去打0.25%

為什麼這個時間點?

三個原因。

第一,機構客戶在要。Morgan Stanley管理著超過$4萬億的客戶資產。當你的客戶是高淨值個人和家族辦公室,他們要的不是最好的ETF,而是"合規部門能批的ETF"。自家品牌+最低費率=完美答案。

第二,費率戰是護城河。ETF一旦規模做起來,費率優勢就會滾雪球。Vanguard用低費率打敗了整個共同基金行業,這個策略Morgan Stanley學到了。

Bloomberg的ETF分析師預計MSBT在4月初獲批上線。

我的判斷很簡單:這不是一個ETF產品的新聞。這是華爾街傳統勢力和加密原生勢力全面整合的信號。當Morgan Stanley願意用最低費率去搶這個市場,說明一件事——

它不是在試水。它是在搶地盤。

一年後回頭看,這可能是BTC ETF費率戰的轉折點。便宜,從來都是最強的護城河

發這條是讓你對BTC有點信心,要不然整個timeline沒有人提crypto了

Morgan Stanley MSBT:0.14%

Grayscale Mini Trust:0.15%

Franklin Templeton EZBC:0.19%

Bitwise / VanEck:0.20%

BlackRock IBIT:0.25%

IBIT目前是$840億BTC現貨ETF市場的絕對龍頭。Morgan Stanley用0.14%去打0.25%

為什麼這個時間點?

三個原因。

第一,機構客戶在要。Morgan Stanley管理著超過$4萬億的客戶資產。當你的客戶是高淨值個人和家族辦公室,他們要的不是最好的ETF,而是"合規部門能批的ETF"。自家品牌+最低費率=完美答案。

第二,費率戰是護城河。ETF一旦規模做起來,費率優勢就會滾雪球。Vanguard用低費率打敗了整個共同基金行業,這個策略Morgan Stanley學到了。

Bloomberg的ETF分析師預計MSBT在4月初獲批上線。

我的判斷很簡單:這不是一個ETF產品的新聞。這是華爾街傳統勢力和加密原生勢力全面整合的信號。當Morgan Stanley願意用最低費率去搶這個市場,說明一件事——

它不是在試水。它是在搶地盤。

一年後回頭看,這可能是BTC ETF費率戰的轉折點。便宜,從來都是最強的護城河

發這條是讓你對BTC有點信心,要不然整個timeline沒有人提crypto了

BTC0.38%

- 打賞

- 1

- 留言

- 轉發

- 分享

債券交易員已經完全放棄2026年降息預期。

油價推高通脹,Core PCE 3.1%(目標2%)。同時經濟在放緩。

這叫滯脹。高物價+低增長,最難受的組合。

股市還在糾結漲跌。債市已經在定價衰退了。

歷史上每次股市和債市講的故事不一樣,最後都是債市對了。

查看原文油價推高通脹,Core PCE 3.1%(目標2%)。同時經濟在放緩。

這叫滯脹。高物價+低增長,最難受的組合。

股市還在糾結漲跌。債市已經在定價衰退了。

歷史上每次股市和債市講的故事不一樣,最後都是債市對了。

- 打賞

- 1

- 留言

- 轉發

- 分享

之前政府關門,DHS斷糧,TSA沒發工資,數百人辭職,數千人不來上班。機場安檢排幾個小時。

參議院通過了一個方案,眾議院說"是個笑話"。眾議院通過了一個方案,參議院不會過。

這就是美國2026的治理水平

查看原文參議院通過了一個方案,眾議院說"是個笑話"。眾議院通過了一個方案,參議院不會過。

這就是美國2026的治理水平

- 打賞

- 按讚

- 留言

- 轉發

- 分享

熱門話題

查看更多21.32萬 熱度

22.45萬 熱度

12.2萬 熱度

133.44萬 熱度

37.26萬 熱度

置頂

✍️ Gate 廣場「創作者認證激勵計劃」進行中!

我們歡迎優質創作者積極創作,申請認證

贏取豪華代幣獎池、Gate 精美周邊、流量曝光等超過 $10,000+ 豐厚獎勵!

立即報名 👉 https://www.gate.com/questionnaire/7159

📕 認證申請步驟:

1️⃣ App 首頁底部進入【廣場】 → 點擊右上角頭像進入個人主頁

2️⃣ 點擊頭像右下角【申請認證】進入認證頁面,等待審核

讓優質內容被更多人看到,一起共建創作者社區!

活動詳情:https://www.gate.com/announcements/article/47889#Gate广场四月发帖挑战 狂歡開啟!🧧

發帖即賺,天天都有紅包領,新人100%中獎!

🎁 福利亮點:

✅ 新人禮: 發布廣場首帖,100% 必中紅包!

✅ 發帖獎: 發帖越多,互動越多,紅包金額越大!

✅ 分享王: 轉發活動連結到廣場或外部平台,送 Gate 開瓶器 + 200U!

✅ 衝榜單: Top 100 都有獎,Gate 13 周年限定禮盒、紅牛夾克等您拿!

立即行動,發佈你的四月廣場第一帖!

👉️ https://www.gate.com/post

🗓 截止日期: 4 月 15 日

詳情:https://www.gate.com/announcements/article/50520