Anthropic ฟ้องรัฐบาลทรัมป์: ป้าย "ความเสี่ยงห่วงโซ่อุปทาน" เป็นการแก้แค้นที่ผิดกฎหมาย

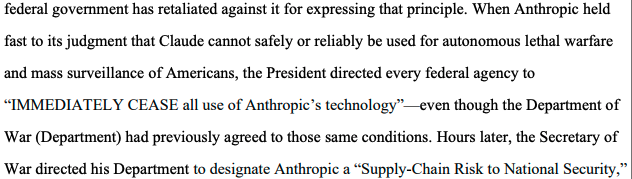

บริษัทผู้พัฒนาซอฟต์แวร์ปัญญาประดิษฐ์ Claude อย่าง Anthropic เมื่อวันจันทร์ได้ยื่นฟ้องต่อศาลรัฐบาลกลางในรัฐแคลิฟอร์เนีย โดยกล่าวหารัฐบาลว่าได้ดำเนินการ “การตอบโต้โดยผิดกฎหมาย” ต่อบริษัท เนื่องจาก Anthropic ปฏิเสธที่จะอนุญาตให้กองทัพใช้เทคโนโลยีของตนอย่างไม่จำกัด รวมถึงการใช้ในอาวุธอัตโนมัติที่มีความรุนแรงและการเฝ้าระวังภายในประเทศในวงกว้าง นับเป็นครั้งแรกในประวัติศาสตร์สหรัฐอเมริกาที่บริษัทในประเทศถูกระบุว่าเป็นความเสี่ยงในห่วงโซ่อุปทานของกองทัพ

ป้ายบ่งชี้ความเสี่ยงในห่วงโซ่อุปทาน: การรับรองที่ไม่เคยมีมาก่อนของกระทรวงกลาโหม

จุดเริ่มต้นของคดีนี้คือการตัดสินใจสุดท้ายของรัฐมนตรีกลาโหม Pete Hegseth เมื่อวันที่ 3 มีนาคม ค.ศ. 2026 ให้จัด Anthropic เป็นบริษัทที่มีความเสี่ยงในห่วงโซ่อุปทานของกองทัพ ผลของการรับรองนี้มีผลทางกฎหมายโดยตรงและรุนแรง—บุคคลหรือบริษัทใดก็ตามที่มีธุรกิจกับกองทัพ จะไม่สามารถทำธุรกรรมใด ๆ กับ Anthropic ได้อีก ซึ่งเท่ากับการตัดออกจากตลาดจัดซื้อจัดจ้างของรัฐบาลกลางอย่างสมบูรณ์

น่าสังเกตว่าการรับรองความเสี่ยงในห่วงโซ่อุปทานเช่นนี้ ก่อนหน้านี้เคยใช้กับบริษัทที่ถูกกล่าวหาว่ามีความสัมพันธ์กับฝ่ายตรงข้ามต่างชาติเท่านั้น ไม่เคยนำมาใช้กับบริษัทในประเทศของสหรัฐอเมริกาเลย ในการฟ้องร้อง Anthropic เรียกการกระทำนี้ว่า “การกระทำที่ไม่เคยมีมาก่อนและผิดกฎหมาย” และอ้างว่า “รัฐธรรมนูญไม่อนุญาตให้รัฐบาลใช้อำนาจอันมหาศาลของตนลงโทษบริษัทที่แสดงออกซึ่งเสรีภาพในการแสดงความคิดเห็น”

ฝ่ายจำเลยในคดีนี้ประกอบด้วยบุคคลจำนวนมาก รวมถึง Pete Hegseth (รัฐมนตรีกลาโหม), Scott Bessent (รัฐมนตรีคลัง), Marco Rubio (รัฐมนตรีต่างประเทศ) และเจ้าหน้าที่และหน่วยงานรัฐบาลอีก 17 แห่ง ซึ่งครอบคลุมหลายหน่วยงานหลักของรัฐบาลกลางสหรัฐ

เส้นแดงสำคัญของ Anthropic: อาวุธรุนแรงและการเฝ้าระวังในวงกว้าง

(ที่มา: CourtListener)

จากคำให้การในคดี Anthropic ระบุว่า Hegseth เรียกร้องให้บริษัท “ละทิ้งข้อจำกัดในการใช้งาน” ของตน ซึ่งเหตุผลที่ Anthropic ปฏิเสธคือ ข้อจำกัดเหล่านี้เป็นส่วนหนึ่งของสัญญาระหว่างบริษัทกับรัฐบาล และมีเป้าหมายเพื่อป้องกันไม่ให้ Claude ถูกนำไปใช้ในสองกลุ่มเป้าหมายเฉพาะ ได้แก่

ระบบอาวุธอัตโนมัติที่มีความรุนแรง: ระบบการตัดสินใจฆ่าโดยอัตโนมัติที่ไม่ต้องการการยืนยันจากมนุษย์ในที่สุด

การเฝ้าระวังในวงกว้างของพลเมืองสหรัฐ: การใช้เทคโนโลยี AI ในการเก็บรวบรวมและวิเคราะห์ข้อมูลส่วนบุคคลของพลเมืองในระดับมวลชน

Anthropic ระบุในคดีว่า “Anthropic ไม่เคยทดสอบ Claude สำหรับการใช้งานในกลุ่มเป้าหมายเหล่านี้ และปัจจุบันก็ไม่แน่ใจว่า หากนำ Claude ไปใช้สนับสนุนสงครามอัตโนมัติที่เป็นอันตรายต่อชีวิต มันจะสามารถทำงานได้อย่างเชื่อถือได้หรือปลอดภัยหรือไม่”

จุดยืนนี้สอดคล้องกับหลักการความปลอดภัยของ AI ที่ Anthropic ยึดถือมาโดยตลอด แต่ขัดแย้งอย่างรุนแรงกับนโยบายของรัฐบาลทรัมป์ที่มุ่งขยายการใช้งาน AI ทางทหารอย่างมาก นอกจากนี้ ตั้งแต่ปี 2024 เป็นต้นมา รัฐบาลและกระทรวงกลาโหมของสหรัฐฯ ก็ได้ใช้งานเทคโนโลยีของ Anthropic โดย Claude เป็น AI ตัวแรกที่ถูกนำไปใช้ในสภาพแวดล้อมลับสุดยอด การรับรองนี้ยังมาพร้อมคำสั่งของทรัมป์ให้เจ้าหน้าที่ของรัฐบาลกลางหยุดใช้ Claude โดยตรง

กลุ่มสนับสนุนจากวิศวกร OpenAI และ Google: การตอบสนองร่วมของอุตสาหกรรม AI

หลังจากเกิดคดีนี้ การตอบสนองจากอุตสาหกรรม AI ก็รวดเร็วและกว้างขวาง เมื่อวันจันทร์ที่ผ่านมา วิศวกรและนักวิทยาศาสตร์มากกว่า 30 คนจาก OpenAI และ Google รวมถึง Jeff Dean หัวหน้านักวิทยาศาสตร์ของ Google ได้ยื่นคำร้องสนับสนุนทางกฎหมาย (amicus brief) ออกมาแสดงจุดยืนสนับสนุน Anthropic

บุคคลในอุตสาหกรรมเหล่านี้เตือนในเอกสารว่า “หากอนุญาตให้ดำเนินการลงโทษบริษัท AI ชั้นนำของอเมริกาเช่นนี้ต่อไป จะส่งผลเสียต่อความสามารถในการแข่งขันด้านอุตสาหกรรมและวิทยาศาสตร์ของสหรัฐในด้านปัญญาประดิษฐ์และสาขาอื่น ๆ อย่างแน่นอน” คำกล่าวนี้สะท้อนความกังวลในระดับที่กว้างขึ้นว่า หากรัฐบาลใช้กลยุทธ์การบีบคั้นบริษัท AI ในประเทศโดยอ้างความเสี่ยงในห่วงโซ่อุปทาน ก็อาจทำให้สหรัฐเสียเปรียบในเวทีการแข่งขัน AI ระดับโลกกับจีน

คำถามที่พบบ่อย

“ป้ายบ่งชี้ความเสี่ยงในห่วงโซ่อุปทาน” ส่งผลต่อ Anthropic อย่างไร?

ตามกฎหมายของสหรัฐฯ การถูกจัดเป็นบริษัทที่มีความเสี่ยงในห่วงโซ่อุปทาน หมายความว่า บุคคลหรือองค์กรที่มีธุรกิจกับกองทัพจะไม่สามารถทำธุรกรรมใด ๆ กับบริษัทที่ถูกระบุชื่อได้ ซึ่งเท่ากับการตัด Anthropic ออกจากระบบการจัดซื้อจัดจ้างของรัฐบาลกลางอย่างสมบูรณ์ ส่งผลกระทบไม่เฉพาะแค่สัญญาทางทหารโดยตรง แต่รวมถึงซัพพลายเออร์และพันธมิตรที่มีธุรกิจกับรัฐบาลด้วย

ทำไม Anthropic จึงปฏิเสธการเปิดใช้งานในกลุ่มเป้าหมายอาวุธรุนแรง?

Anthropic ยืนยันว่ายังไม่เคยทดสอบหรือประเมินความปลอดภัยของ Claude สำหรับการใช้งานในกลุ่มเป้าหมายอาวุธรุนแรง และบริษัทไม่สามารถรับประกันความน่าเชื่อถือและความปลอดภัยในสถานการณ์เหล่านี้ได้ นอกจากนี้ หลักการด้านความปลอดภัยของ AI ของ Anthropic ก็ต่อต้านการนำระบบอัตโนมัติที่มีความเสี่ยงสูงไปใช้ในสถานการณ์ที่เกี่ยวข้องกับชีวิตมนุษย์โดยไม่ได้รับการทดสอบอย่างเพียงพอ

การสนับสนุนจากวิศวกรของ Google และ OpenAI ต่อ Anthropic หมายความว่าอย่างไร?

การร่วมลงชื่อสนับสนุนของวิศวกรและนักวิทยาศาสตร์จากบริษัทคู่แข่งกว่า 30 คน แสดงให้เห็นถึงความกังวลของอุตสาหกรรม AI ต่อการใช้อำนาจของรัฐบาลในการแทรกแซงบริษัท AI ด้วยกลยุทธ์ป้ายบ่งชี้ความเสี่ยงในห่วงโซ่อุปทาน ซึ่งอาจนำไปสู่การกดดันบริษัทที่ไม่ยอมเปิดเผยเทคโนโลยีหรือข้อจำกัดด้านความปลอดภัยของตนเองในอนาคต